Ya que el concepto de procedimiento efectivo es un concepto intuitivo, impreciso y a priori no expresado en el formalismo matemático, los conceptos de

adhocprefix-adhocsufix Función \(\Sigma\)-efectivamente computable

adhocprefix-adhocsufix Conjunto \(\Sigma\)-efectivamente computable

adhocprefix-adhocsufix Conjunto \(\Sigma\)-efectivamente enumerable

también son imprecisos y están fuera del formalismo matemático, debido a que los tres se definen en términos de la existencia de procedimientos efectivos. Por supuesto, los tres conceptos son fundamentales en el estudio teórico de la computabilidad por lo que es muy importante poder dar un modelo o formalización matemática de estos conceptos. Pero nótese que los dos últimos se definen en función del primero por lo que una formalización matemática precisa del concepto de función \(\Sigma\)-efectivamente computable, resuelve el problema de modelizar en forma matemática estos tres conceptos.

En este capítulo daremos las tres modelizaciones matemáticas mas clásicas del concepto de función \(\Sigma\)-efectivamente computable. La primera y la mas apegada a la idea intuitiva de procedimiento efectivo es la dada por Alan Turing vía la matematización del concepto de máquina. Llamaremos a esta modelización el paradigma de Turing. La segunda, es la dada por Godel en su estudio de sistemas formales de la lógica de primer orden. Llamaremos a esta modelización el paradigma de Godel o el paradigma funcional o el paradigma recursivo. Por último veremos una formalización vía un lenguaje de programación imperativo. En honor a la influencia que tuvo Von Neumann en el diseño de la primer computadora de carácter universal (i.e. programable de propósito general), llamaremos a este paradigma el paradigma de Neumann o el paradigma imperativo. Dada la naturaleza filosófica e imprecisa del concepto de procedimiento efectivo y de sus conceptos derivados (i.e. función \(\Sigma\)-efectivamente computable, etc) a este conjunto de conceptos fundamentales para las ciencias de la computación lo llamaremos el paradigma filosófico. En honor al filosofo y matemático Gottfried Leibniz llamaremos también al paradigma filosófico, el paradigma de Leibniz. Cabe destacar que Leibniz creo la primera máquina de calcular, llamada la Stepped Reckoner.

Con esta manera de hablar nótese que los paradigmas matemáticos de Turing, Godel y Neumann intentan modelizar al paradigma de Leibniz. Para darle un toque de humor expresaremos esto diciendo que Turing, Godel y Neumann intentan vencer a Leibniz.

Estudiaremos el concepto de máquina de Turing, el cual fue introducido por Alan Turing para formalizar o modelizar matemáticamente la idea de procedimiento efectivo. Una vez definidas las máquinas podremos dar una modelización matemática precisa del concepto de función \(\Sigma\)-efectivamente computable. Llamaremos a estas funciones \(\Sigma\)-Turing computables y serán aquellas que (en algún sentido que será bien precisado matemáticamente) pueden ser computadas por una máquina de Turing. Por supuesto, la fidedignidad de este concepto, es decir cuan buena es la modelización matemática dada por Turing, puede no ser clara al comienzo pero a medida que vayamos avanzando en nuestro estudio y conozcamos además los otros paradigmas y su relación, quedara claro que el modelo de Turing es acertado.

Vivimos en un mundo plagado de máquinas (ascensores, celulares, relojes, taladros, etc). Una característica común a todas las máquinas es que tienen distintos estados posibles. Un estado es el conjunto de características que determinan un momento concreto posible de la máquina cuando esta funcionando. Por ejemplo un estado posible de un ascensor seria:

adhocprefix-adhocsufix esta en el tercer piso, con la primer puerta abierta y la otra cerrada, esta apretado el botón de ir al sexto piso, etc

donde ponemos etc porque dependiendo del tipo de ascensor (si es con memoria, a que pisos puede ir, etc) habrá mas datos que especificar para determinar un estado concreto.

Otra característica común de las máquinas es que interactúan de distintas formas con el usuario o mas generalmente su entorno. Dependiendo de que acción se ejecute sobre la máquina y en que estado este, la máquina realizará alguna tarea y además cambiará de estado. En general las máquinas son deterministicas en el sentido que siempre que estén en determinado estado y se les aplique determinada acción, realizarán la misma tarea y pasarán al mismo estado.

Son un modelo abstracto de máquina con una cantidad finita de estados la cual trabaja sobre una cinta de papel dividida en cuadros e interactuá o recibe acciones externas por medio de una cabeza lectora que lee de a un cuadro de la cinta a la ves y además puede borrar el contenido del cuadro leído y escribir en el un símbolo. También la cabeza lectora puede moverse un cuadro hacia la izquierda o hacia la derecha o quedarse en el mismo cuadro. La cinta tiene un primer cuadro hacia su izquierda pero hacia la derecha puede extenderse todo lo necesario. En un cuadro de la cinta podrá haber un símbolo o un cuadro puede simplemente estar en blanco. Es decir que habrá un alfabeto \(\Gamma\) el cual consiste de todos los símbolos que pueden figurar en la cinta. Esto será parte de los datos o características de cada máquina, es decir, \(\Gamma\) puede cambiar dependiendo de la máquina. La máquina, en función del estado en que se encuentre y de lo que vea su cabeza lectora en el cuadro escaneado, podrá moverse a lo sumo un cuadro (izquierda, derecha o quedarse quieta), modificar lo que encuentre en dicho cuadro (borrando y escribiendo algún nuevo símbolo) y cambiar de estado (posiblemente al mismo que tenia). Para simplificar supondremos que hay en \(\Gamma\) un símbolo el cual si aparece en un cuadro de la cinta, significara que dicho cuadro esta sin escribir o en blanco. Esto nos permitirá describir mas fácilmente el funcionamiento de la máquina. En gral llamaremos \(B\) a tal símbolo. También por lo general llamaremos \(Q\) al conjunto de estados de la máquina.

También cada máquina tendrá un estado especial el cual será llamado su estado inicial, generalmente denotado con \(q_{0}\), el cual será el estado en el que estará la máquina al comenzar a trabajar sobre la cinta. Hay otras características que tendrán las máquinas de Turing pero para dar un primer ejemplo ya nos basta. Describiremos una máquina de Turing \(M\) que tendrá \(\Gamma=\{@,a,b,B\}\) y tendrá dos estados, es decir \(Q=\{q_{0},q_{1}\}\). Obviamente \(q_{0}\) será su estado inicial y además el "comportamiento o personalidad" de \(M\) estará dado por las siguientes clausulas:

adhocprefix-adhocsufix Estando en estado \(q_{0}\) si ve ya sea \(b\) o \(B\) o \(@\), entonces se queda en estado \(q_{0}\) y se mueve a la derecha

adhocprefix-adhocsufix Estando en estado \(q_{0}\) si ve \(a\) entonces reescribe \(@\), se mueve a la izquierda y cambia al estado \(q_{1}\)

adhocprefix-adhocsufix Estando en estado \(q_{1}\) si ve \(a\) o \(b\) o \(B\) o \(@\) entonces lo deja como esta, se mueve a la izquierda y queda en estado \(q_{1}\)

Supongamos ahora que tomamos una palabra \(\alpha\in\Gamma^{\ast}\) y la distribuimos en la cinta dejando el primer cuadro en blanco y luego poniendo los símbolos de \(\alpha\) en los siguientes cuadros. Supongamos además que ponemos la máquina en estado \(q_{0}\) y con su cabeza lectora escaneando el primer cuadro de la cinta. Esto lo podemos representar gráficamente de la siguiente manera \[\begin{array}{cccccccc} B & \alpha_{1} & ... & \alpha_{n} & B & B & B & ...\\ \uparrow\\ q_{0} \end{array}\] donde \(\alpha_{1},...,\alpha_{n}\) son los sucesivos símbolos de \(\alpha\). Supongamos además que \(a\) ocurre en \(\alpha\). Dejamos al lector ir aplicando las clausulas de \(M\) para convencerse que luego de un rato de funcionar \(M\), la situación será \[\begin{array}{cccccccc} B & \beta_{1} & ... & \beta_{n} & B & B & B & ...\\ \uparrow\\ q_{1} \end{array}\] donde \(\beta_{1}...\beta_{n}\) es el resultado de reemplazar en \(\alpha\) la primer ocurrencia de \(a\) por \(@\). Dejamos como ejercicio para el lector averiguar que sucede cuando \(a\) no ocurre en \(\alpha\)

Una cosa que puede pasar es que para un determinado estado \(p\) y un \(\sigma\in\Gamma\), la máquina no tenga contemplada ninguna acción posible. Por ejemplo sea \(M\) la máquina de Turing dada por \(Q=\{q_{0}\}\), \(\Gamma=\{@,\$,B\}\) y por la siguiente clausula:

adhocprefix-adhocsufix Estando en estado \(q_{0}\) si ve ya sea \(@\) o \(B\), entonces se queda en estado \(q_{0}\) y se mueve a la derecha

Es fácil ver que si partimos de una situación \[\begin{array}{cccccccc} B & \alpha_{1} & ... & \alpha_{n} & B & B & B & ...\\ \uparrow\\ q_{0} \end{array}\] donde \(\alpha_{1},...,\alpha_{n}\in\Gamma\), entonces si ningún \(\alpha_{i}\) es igual a \(\$\), la máquina se moverá indefinidamente hacia la derecha y en caso contrario se moverá \(i\) pasos a la derecha y se detendrá, donde \(i\) es el menor \(l\) tal que \(\alpha_{l}=\$\).

Otro caso posible de detención de una máquina de Turing es cuando esta escaneando el primer cuadro de la cinta y su única acción posible implica moverse un cuadro a la izquierda. También en estos casos diremos que la máquina se detiene ya que la cinta no es extensible hacia la izquierda.

Otra característica de las máquinas de Turing es que poseen un alfabeto de entrada el cual esta contenido en el alfabeto \(\Gamma\) y en el cual están los símbolos que se usaran para formar la configuración inicial de la cinta (excepto \(B\)). En general lo denotaremos con \(\Sigma\) al alfabeto de entrada y los símbolos de \(\Gamma-\Sigma\) son considerados auxiliares. También habrá un conjunto \(F\) contenido en el conjunto \(Q\) de los estados de la máquina, cuyos elementos serán llamados estados finales.

Diremos que una palabra \(\alpha=\alpha_{1}...\alpha_{n}\in\Sigma^{\ast}\) es aceptada por \(M\) por alcance de estado final si partiendo de \[\begin{array}{cccccccc} B & \alpha_{1} & ... & \alpha_{n} & B & B & B & ...\\ \uparrow\\ q_{0} \end{array}\] en algún momento de la computación \(M\) esta en un estado de \(F\). Llamaremos \(L(M)\) al conjunto formado por todas las palabras que son aceptadas por alcance de estado final

Diremos que una palabra \(\alpha=\alpha_{1}...\alpha_{n}\in\Sigma^{\ast}\) es aceptada por \(M\) por detención si partiendo de \[\begin{array}{cccccccc} B & \alpha_{1} & ... & \alpha_{n} & B & B & B & ...\\ \uparrow\\ q_{0} \end{array}\] en algún momento \(M\) se detiene. Llamaremos \(H(M)\) al conjunto formado por todas las palabras que son aceptadas por detención

Seguiremos bastante fidedignamente el tratamiento dado en el libro de Hopcroft y Ullman. Una máquina de Turing es una 7-upla \(M=\left(Q,\Sigma,\Gamma,\delta,q_{0},B,F\right)\) donde

adhocprefix-adhocsufix \(Q\) es un conjunto finito cuyos elementos son llamados estados

adhocprefix-adhocsufix \(\Gamma\) es un alfabeto que contiene a \(\Sigma\)

adhocprefix-adhocsufix \(\Sigma\) es un alfabeto llamado el alfabeto de entrada

adhocprefix-adhocsufix \(B\in\Gamma-\Sigma\) es un símbolo de \(\Gamma\) llamado el blank symbol

adhocprefix-adhocsufix \(\delta:D_{\delta}\subseteq Q\times\Gamma\rightarrow Q\times\Gamma\times\{L,R,K\}\)

adhocprefix-adhocsufix \(q_{0}\) es un estado llamado el estado inicial de \(M\)

adhocprefix-adhocsufix \(F\subseteq Q\) es un conjunto de estados llamados finales

Nótese que la función \(\delta\) da la "personalidad" de la máquina. Describiremos esto informalmente y después cuando definamos la relación \(\vdash\) mas abajo esta idea quedara precisada en forma matemática.

adhocprefix-adhocsufix \(\delta(p,\sigma)=(q,\gamma,L)\) significara que: si \(M\) esta en estado \(p\) y su cabezal esta escaneando una casilla distinta de la primera, en la cual esta dibujado el símbolo \(\sigma\), entonces la máquina hará lo siguiente:

borrara \(\sigma\) y escribirá \(\gamma\) en su lugar, luego

se moverá un cuadro a la izquierda y luego

pasara al estado \(q\)

adhocprefix-adhocsufix \(\delta(p,\sigma)=(q,\gamma,K)\) significara que: si \(M\) esta en estado \(p\) y su cabezal esta escaneando una casilla en la cual esta dibujado el símbolo \(\sigma\), entonces la máquina hará lo siguiente:

borrara \(\sigma\) y escribirá \(\gamma\) en su lugar, luego

pasara al estado \(q\)

(es decir que el cabezal se queda kieto)

adhocprefix-adhocsufix \(\delta(p,\sigma)=(q,\gamma,R)\) significara que: si \(M\) esta en estado \(p\) y su cabezal esta escaneando una casilla en la cual esta dibujado el símbolo \(\sigma\), entonces la máquina hará lo siguiente:

borrara \(\sigma\) y escribirá \(\gamma\) en su lugar, luego

se moverá un cuadro a la derecha y luego

pasara al estado \(q\)

Los casos arriba descriptos son los únicos en los cuales la máquina \(M\) trabajara. O sea que si \((p,\sigma)\in(Q\times\Gamma)-D_{\delta}\) entonces \(M\) estando en estado \(p\) y con el cabezal leyendo el símbolo \(\sigma\) no puede hacer nada es decir solo permanecer quieta en el lugar de la cinta que este. También si \(\delta(p,\sigma)=(q,\gamma,L)\), entonces cuando \(M\) este en estado \(p\), con su cabezal escaneando la primer casilla y en la cual este dibujado el símbolo \(\sigma\), \(M\) no podrá hacer nada, lo cual es razonable ya que la cinta no es extensible hacia la izquierda.

Si bien en nuestra definición de máquina de Turing no hay ninguna restricción acerca de la naturaleza de los elementos de \(Q\), para continuar nuestro análisis asumiremos siempre que \(Q\) es un alfabeto disjunto con \(\Gamma\). Esto nos permitirá dar definiciones matemáticas precisas que formalizaran el funcionamiento de las máquinas de Turing en el contexto de las funciones mixtas. Debería quedar claro que el hecho que solo trabajemos con máquinas en las cuales \(Q\) es un alfabeto disjunto con \(\Gamma\), no afectara la profundidad y generalidad de nuestros resultados y definiciones.

Una descripción instantánea será una palabra de la forma \(\alpha q\beta\), donde \(\alpha,\beta\in\Gamma^{\ast}\), \(\left[\beta\right]_{\left\vert \beta\right\vert }\neq B\) y \(q\in Q\). Nótese que la condición \(\left[\beta\right]_{\left\vert \beta\right\vert }\neq B\) nos dice que \(\beta=\varepsilon\) o el último símbolo de \(\beta\) es distinto de \(B\). La descripción instantánea \(\alpha_{1}...\alpha_{n}q\beta_{1}...\beta_{m}\), con \(\alpha_{1},...,\alpha_{n}\), \(\beta_{1},...,\beta_{m}\in\Gamma\), \(n,m\geq0\) representara la siguiente situación \[\begin{array}{cccccccccccc} \alpha_{1} & \alpha_{2} & ... & \alpha_{n} & \beta_{1} & \beta_{2} & ... & \beta_{m} & B & B & B & ...\\ & & & & \uparrow\\ & & & & q \end{array}\] Nótese que aquí \(n\) y \(m\) pueden ser \(0\). Por ejemplo si \(n=0\) tenemos que \(\alpha_{1}...\alpha_{n}q\beta_{1}...\beta_{m}=q\beta_{1}...\beta_{m}\) y representa la siguiente situación \[\begin{array}{cccccccccccc} \beta_{1} & \beta_{2} & ... & \beta_{m} & B & B & B & ...\\ \uparrow\\ q \end{array}\] Si \(m=0\) tenemos que \(\alpha_{1}...\alpha_{n}q\beta_{1}...\beta_{m}=\alpha_{1}...\alpha_{n}q\) y representa la siguiente situación \[\begin{array}{cccccccccccc} \alpha_{1} & \alpha_{2} & ... & \alpha_{n} & B & B & ... & & & & ...\\ & & & & \uparrow\\ & & & & q \end{array}\] Si ambos \(n\) y \(m\) son \(0\) entonces tenemos que \(\alpha_{1}...\alpha_{n}q\beta_{1}...\beta_{m}=q\) y representa la siguiente situación \[\begin{array}{cccccccccccc} B & B & B & ...\\ \uparrow\\ q \end{array}\] La condición de que en una descripción instantánea \(\alpha q\beta\) deba suceder que \(\left[\beta\right]_{\left\vert \beta\right\vert }\neq B\) es para que haya una correspondencia biunívoca entre descripciones instantáneas y situaciones de funcionamiento de la máquina. Dejamos al lector meditar sobre esto hasta convencerse de su veracidad. Pero siempre debe tener presente que las descripciones instantáneas son palabras que describen una situación real de algún instante en el funcionamiento de la máquina

Usaremos \(Des\) para denotar el conjunto de las descripciones instantáneas. Definamos la función \(St:Des\rightarrow Q\), de la siguiente manera \[St(d)=\text{unico simbolo de }Q\text{ que ocurre en }d\]

Dado \(\alpha\in(Q\cup\Gamma)^{\ast}\), definamos \(\left\lfloor \alpha\right\rfloor\) de la siguiente manera \[\begin{aligned} \left\lfloor \varepsilon\right\rfloor & =\varepsilon\\ \left\lfloor \alpha\sigma\right\rfloor & =\alpha\sigma\text{, si }\sigma\neq B\\ \left\lfloor \alpha B\right\rfloor & =\left\lfloor \alpha\right\rfloor \end{aligned}\] Es decir \(\left\lfloor \alpha\right\rfloor\) es el resultado de remover de \(\alpha\) el tramo final mas grande de la forma \(B^{n}\). Dada cualquier palabra \(\alpha\) definimos \[^{\curvearrowright}\alpha=\left\{ \begin{array}{lll} \left[\alpha\right]_{2}...\left[\alpha\right]_{\left\vert \alpha\right\vert } & \text{si} & \left\vert \alpha\right\vert \geq2\\ \varepsilon & \text{si} & \left\vert \alpha\right\vert \leq1 \end{array}\right.\ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \alpha^{\curvearrowleft}=\left\{ \begin{array}{lll} \left[\alpha\right]_{1}...\left[\alpha\right]_{\left\vert \alpha\right\vert -1} & \text{si} & \left\vert \alpha\right\vert \geq2\\ \varepsilon & \text{si} & \left\vert \alpha\right\vert \leq1 \end{array}\right.\]

Observación: Nótese que si \(\alpha p\beta\) es una descripción instantánea, entonces en la situación real que ella describe la cabeza lectora de la máquina esta leyendo el símbolo \(\left[\beta B\right]_{1}\) (o sea el 1er símbolo de \(\beta\) si \(\beta\neq\varepsilon\) y \(B\) en caso contrario). Esta forma cheta de describir que símbolo lee la cabeza lectora nos será útil para definir a continuación la relación \(\vdash\). Dadas \(d_{1},d_{2}\in Des\), escribiremos \(d_{1}\vdash d_{2}\) cuando existan \(\sigma\in\Gamma\), \(\alpha,\beta\in\Gamma^{\ast}\) y \(p,q\in Q\) tales que se cumple alguno de los siguientes casos

Caso 1. \[\begin{aligned} d_{1} & =\alpha p\beta\\ \delta\left(p,\left[\beta B\right]_{1}\right) & =(q,\sigma,R)\\ d_{2} & =\alpha\sigma q^{\curvearrowright}\beta \end{aligned}\]

Caso 2. \[\begin{aligned} d_{1} & =\alpha p\beta\\ \delta\left(p,\left[\beta B\right]_{1}\right) & =(q,\sigma,L)\text{ y }\alpha\neq\varepsilon\\ d_{2} & =\left\lfloor \alpha^{\curvearrowleft}q\left[\alpha\right]_{\left\vert \alpha\right\vert }\sigma^{\curvearrowright}\beta\right\rfloor \end{aligned}\]

Caso 3. \[\begin{aligned} d_{1} & =\alpha p\beta\\ \delta(p,\left[\beta B\right]_{1}) & =(q,\sigma,K)\\ d_{2} & =\left\lfloor \alpha q\sigma^{\curvearrowright}\beta\right\rfloor \end{aligned}\] Escribiremos \(d\nvdash d^{\prime}\) para expresar que no se da \(d\vdash d^{\prime}\). Para \(d,d^{\prime}\in Des\) y \(n\geq0\), escribiremos \(d\overset{n}{\vdash}d^{\prime}\) si existen \(d_{1},...,d_{n+1}\in Des\) tales que \[\begin{aligned} d & =d_{1}\\ d^{\prime} & =d_{n+1}\\ d_{i} & \vdash d_{i+1}\text{, para }i=1,...,n. \end{aligned}\] Nótese que \(d\overset{0}{\vdash}d^{\prime}\) sii \(d=d^{\prime}\). Finalmente definamos \[d\overset{\ast}{\vdash}d^{\prime}\text{ sii }(\exists n\in\omega)\;d\overset{n}{\vdash}d^{\prime}\text{.}\]

Dada \(d\in Des\), diremos que \(M\) se detiene partiendo de \(d\) si existe \(d^{\prime}\in Des\) tal que

adhocprefix-adhocsufix \(d\overset{\ast}{\vdash}d^{\prime}\)

adhocprefix-adhocsufix \(d^{\prime}\nvdash d^{\prime\prime}\), para cada \(d^{\prime\prime}\in Des\)

Debería quedar claro que es posible que \(\alpha p\beta\nvdash d\), para cada descripción instantánea \(d\), y que \(\delta(p,[\beta B]_{1})\) sea no vacío.

Diremos que una palabra \(\alpha\in\Sigma^{\ast}\) es aceptada por \(M\) por alcance de estado final cuando \[\left\lfloor q_{0}B\alpha\right\rfloor \overset{\ast}{\vdash}d\text{, con }d\text{ tal que }St(d)\in F.\] El lenguaje aceptado por \(M\) por alcance de estado final se define de la siguiente manera \[L(M)=\{\alpha\in\Sigma^{\ast}:\alpha\text{ es aceptada por }M\text{ por alcance de estado final}\}\text{.}\]

Diremos que una palabra \(\alpha\in\Sigma^{\ast}\) es aceptada por \(M\) por detención cuando \(M\) se detiene partiendo de \(\left\lfloor q_{0}B\alpha\right\rfloor\). El lenguaje aceptado por \(M\) por detención se define de la siguiente manera \[H(M)=\{\alpha\in\Sigma^{\ast}:\alpha\text{ es aceptada por }M\text{ por detencion}\}\]

Para poder computar funciones mixtas con una máquina de Turing necesitaremos un símbolo para representar números sobre la cinta. Llamaremos a este símbolo unit y lo denotaremos con \(\shortmid\). Mas formalmente una máquina de Turing con unit es una 8-upla \(M=\left(Q,\Sigma,\Gamma,\delta,q_{0},B,\shortmid,F\right)\) tal que \(\left(Q,\Sigma,\Gamma,\delta,q_{0},B,F\right)\) es una máquina de Turing y \(\shortmid\) es un símbolo distinguido perteneciente a \(\Gamma-(\{B\}\cup\Sigma)\).

Diremos que una función \(f:D_{f}\subseteq\omega^{n}\times\Sigma^{\ast m}\rightarrow\Sigma^{\ast}\) es \(\Sigma\)-Turing computable si existe una máquina de Turing con unit, \(M=\left(Q,\Sigma,\Gamma,\delta,q_{0},B,\shortmid,F\right)\) tal que:

adhocprefix(1)adhocsufix Si \((\vec{x},\vec{\alpha})\in D_{f}\), entonces hay un \(p\in Q\) tal que \[\left\lfloor q_{0}B\shortmid^{x_{1}}B...B\shortmid^{x_{n}}B\alpha_{1}B...B\alpha_{m}\right\rfloor \overset{\ast}{\vdash}\left\lfloor pBf(\vec{x},\vec{\alpha})\right\rfloor\] y \(\left\lfloor pBf(\vec{x},\vec{\alpha})\right\rfloor \nvdash d\), para cada \(d\in Des\)

adhocprefix(2)adhocsufix Si \((\vec{x},\vec{\alpha})\in\omega^{n}\times\Sigma^{\ast m}-D_{f}\), entonces \(M\) no se detiene partiendo de \[\left\lfloor q_{0}B\shortmid^{x_{1}}B...B\shortmid^{x_{n}}B\alpha_{1}B...B\alpha_{m}\right\rfloor .\]

En forma similar, una función \(f:D_{f}\subseteq\omega^{n}\times\Sigma^{\ast}{}^{m}\rightarrow\omega\), es llamada \(\Sigma\)-Turing computable si existe una máquina de Turing con unit, \(M=\left(Q,\Sigma,\Gamma,\delta,q_{0},B,\shortmid,F\right)\), tal que:

adhocprefix(1)adhocsufix Si \((\vec{x},\vec{\alpha})\in D_{f}\), entonces hay un \(p\in Q\) tal que \[\left\lfloor q_{0}B\shortmid^{x_{1}}B...B\shortmid^{x_{n}}B\alpha_{1}B...B\alpha_{m}\right\rfloor \overset{\ast}{\vdash}\left\lfloor pB\shortmid^{f(\vec{x},\vec{\alpha})}\right\rfloor\] y \(\left\lfloor pB\shortmid^{f(\vec{x},\vec{\alpha})}\right\rfloor \nvdash d\), para cada \(d\in Des\)

adhocprefix(2)adhocsufix Si \((\vec{x},\vec{\alpha})\in\omega^{n}\times\Sigma^{\ast m}-D_{f}\), entonces \(M\) no se detiene partiendo de \[\left\lfloor q_{0}B\shortmid^{x_{1}}B...B\shortmid^{x_{n}}B\alpha_{1}B...B\alpha_{m}\right\rfloor\]

Cabe destacar que la condición \[\left\lfloor pBf(\vec{x},\vec{\alpha})\right\rfloor \nvdash d,\text{ para cada }d\in Des\] es equivalente a que \((p,B)\) no este en el dominio de \(\delta\) o que si lo este y que la tercer coordenada de \(\delta(p,B)\) sea \(L\).

Cuando una máquina de Turing con unit \(M\) cumpla los items (1) y (2) de la definición anterior, diremos que \(M\) computa a la función \(f\) o que \(f\) es computada por \(M\). Por supuesto esta definición no tendría sentido como modelo matemático del concepto de función \(\Sigma\)-efectivamente computable si no sucediera que toda función \(\Sigma\)-Turing computable fuera \(\Sigma\)-efectivamente computable. Este hecho es intuitivamente claro y lo presentamos a continuación en forma de proposición. En algún sentido esto nos dice que el paradigma filosófico es mas amplio (o igual) al paradigma de Turing. Para darle un toque de humor expresaremos esto diciendo que Leibniz vence a Turing.

4.1 (Leibniz vence a Turing). Sean \(n,m\in\omega\) y \(O\in\{\omega,\Sigma^{\ast}\}\). Si \(f:D_{f}\subseteq\omega^{n}\times\Sigma^{\ast}{}^{m}\rightarrow O\) es computada por una máquina de Turing con unit \(M=\left(Q,\Sigma,\Gamma,\delta,q_{0},B,\shortmid,F\right)\), entonces \(f\) es \(\Sigma\)-efectivamente computable.

Proof. Haremos el caso \(O=\Sigma^{\ast}\). Sea \(\mathbb{P}\) el siguiente procedimiento efectivo.

- Conjunto de datos de entrada de \(\mathbb{P}\) igual a \(\omega^{n}\times\Sigma^{\ast}{}^{m}\)

- Conjunto de datos de salida de \(\mathbb{P}\) contenido en \(O\)

- Funcionamiento: Hacer funcionar paso a paso la máquina \(M\) partiendo de la descripción instantánea \(\left\lfloor q_{0}B\shortmid^{x_{1}}B...B\shortmid^{x_{n}}B\alpha_{1}B...B\alpha_{m}\right\rfloor\). Si en alguna instancia \(M\) termina, dar como salida el resultado de remover de la descripción instantánea final los dos primeros símbolos.

Nótese que este procedimiento termina solo en aquellos elementos \((\vec{x},\vec{\sigma})\in\omega^{n}\times\Sigma^{\ast}{}^{m}\) tales que la máquina \(M\) termina partiendo desde \[\left\lfloor q_{0}B\shortmid^{x_{1}}B...B\shortmid^{x_{n}}B\alpha_{1}B...B\alpha_{m}\right\rfloor\] por lo cual termina solo en los elementos de \(D_{f}\) ya que \(M\) computa a \(f\). Además es claro que en caso de terminación el procedimiento da como salida \(f(\vec{x},\vec{\sigma})\).

Sin embargo el modelo Turingniano podría a priori no ser del todo correcto ya que podría pasar que haya una función que sea computada por un procedimiento efectivo pero que no exista una máquina de Turing que la compute. En otras palabras el modelo podría ser incompleto. La completitud de este modelo puede no ser clara al comienzo pero a medida que vayamos avanzando en nuestro estudio y conozcamos además los otros paradigmas y su relación, quedara claro que el modelo de Turing es acertado, es decir que también pasa que Turing vence a Leibniz.

Ya que la noción de función \(\Sigma\)-Turing computable es el modelo matemático de Turing del concepto de función \(\Sigma\)-efectivamente computable, nos podríamos preguntar entonces cual es el modelo matemático de Turing del concepto de conjunto \(\Sigma\)-efectivamente enumerable. Si prestamos atención a la definición de conjunto \(\Sigma\)-efectivamente enumerable, notaremos que depende de la existencia de cierta función \(F\) por lo cual la siguiente definición cae de maduro:

Diremos que un conjunto \(S\subseteq\omega^{n}\times\Sigma^{\ast m}\) será llamado \(\Sigma\)-Turing enumerable cuando sea vacío o haya una función \(F:\omega\rightarrow\omega^{n}\times\Sigma^{\ast m}\) tal que \(I_{F}=S\) y \(F_{(i)}\) sea \(\Sigma\)-Turing computable, para cada \(i\in\{1,...,n+m\}\).

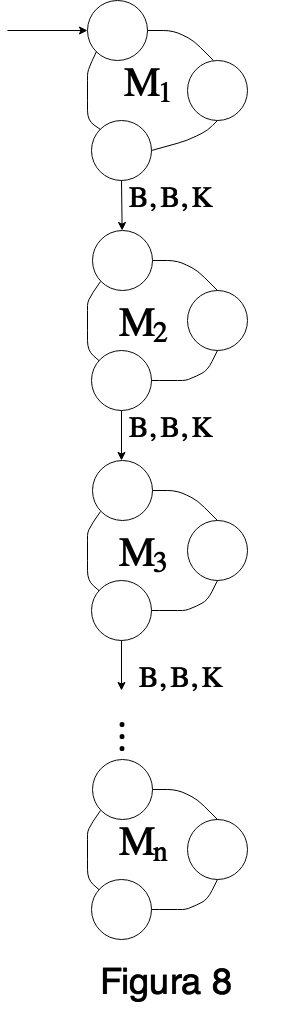

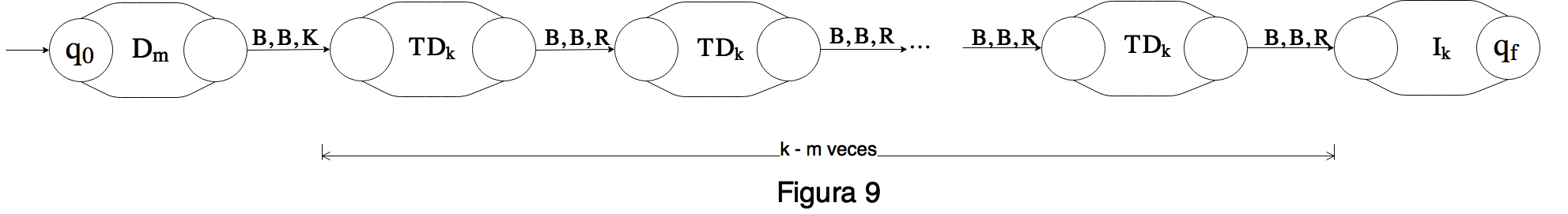

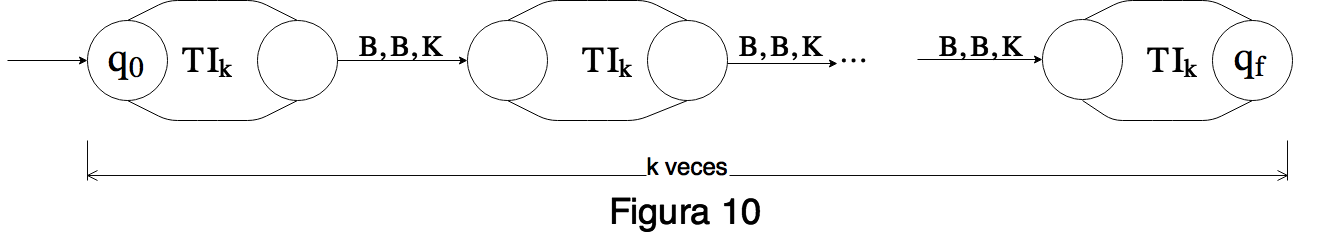

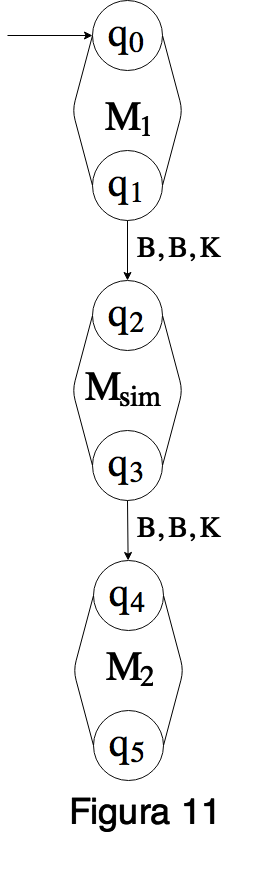

Debería quedar claro que si el concepto de función \(\Sigma\)-Turing computable modeliza correctamente al concepto de función \(\Sigma\)-efectivamente computable, entonces el concepto de conjunto \(\Sigma\)-Turing enumerable recién definido modeliza correctamente al concepto de conjunto \(\Sigma\)-efectivamente enumerable. Nótese que según la definición que acabamos de escribir, un conjunto no vacío \(S\subseteq\omega^{n}\times\Sigma^{\ast m}\) es \(\Sigma\)-Turing enumerable si y solo si hay máquinas de Turing con unit \[\begin{aligned} M_{1} & =\left(Q_{1},\Sigma,\Gamma_{1},\delta_{1},q_{01},B,\shortmid,F_{1}\right)\\ M_{2} & =\left(Q_{2},\Sigma,\Gamma_{2},\delta_{2},q_{02},B,\shortmid,F_{2}\right)\\ & \vdots\\ M_{n+m} & =\left(Q_{n+m},\Sigma,\Gamma_{n+m},\delta_{n+m},q_{0n+m},B,\shortmid,F_{n+m}\right) \end{aligned}\] tales que

adhocprefix-adhocsufix cada \(M_{i}\), con \(i=1,...,n\), computa una función \(F_{i}:\omega\rightarrow\omega\)

adhocprefix-adhocsufix cada \(M_{i}\), con \(i=n+1,...,n+m\), computa una función \(F_{i}:\omega\rightarrow\Sigma^{\ast}\)

adhocprefix-adhocsufix \(S=\mathrm{Im}([F_{1},...,F_{n+m}])\)

Como puede notarse las máquinas \(M_{1},...,M_{n+m}\) puestas secuencialmente a funcionar desde la descripciones instantáneas \[\begin{aligned} & \left\lfloor q_{01}B\shortmid^{x}\right\rfloor \\ & \left\lfloor q_{02}B\shortmid^{x}\right\rfloor \\ & \ \ \ \ \ \ \ \ \ \vdots\\ & \left\lfloor q_{0n+m}B\shortmid^{x}\right\rfloor \end{aligned}\] producen en forma natural un procedimiento efectivo (con dato de entrada \(x\in\omega\)) que enumera a \(S\). Por supuesto podemos decir que en tal caso las máquinas \(M_{1},...,M_{n+m}\) enumeran a \(S\). La siguiente proposición muestra que también las cosas se pueden hacer con una sola máquina de Turing.

4.2. Sea \(S\subseteq\omega^{n}\times\Sigma^{\ast m}\) un conjunto no vacío. Entonces \(S\) es \(\Sigma\)-Turing enumerable si y solo si hay una máquina de Turing con unit \(M=\left(Q,\Sigma,\Gamma,\delta,q_{0},B,\shortmid,F\right)\), tal que:

adhocprefix(1)adhocsufix Para cada \(x\in\omega\), tenemos que \(M\) se detiene partiendo de \(\left\lfloor q_{0}B\shortmid^{x}\right\rfloor\) y llega a una descripción instantánea de la forma \(\left\lfloor qB\shortmid^{x_{1}}B...B\shortmid^{x_{n}}B\alpha_{1}B...B\alpha_{m}\right\rfloor\), con \((\vec{x},\vec{\alpha})\in S\).

adhocprefix(2)adhocsufix Para cada \((\vec{x},\vec{\alpha})\in S\) hay un \(x\in\omega\) tal que \(M\) se detiene partiendo de \(\left\lfloor q_{0}B\shortmid^{x}\right\rfloor\) y llega a una descripción instantánea de la forma \(\left\lfloor qB\shortmid^{x_{1}}B...B\shortmid^{x_{n}}B\alpha_{1}B...B\alpha_{m}\right\rfloor\)

Proof. Queda como ejercicio ver como construir la máquina \(M\) utilizando las máquinas \(M_{1},...,M_{n+m}\) y recíprocamente ver como a partir de una máquina \(M\) con las propiedades (1) y (2) se pueden construir las máquinas \(M_{1},...,M_{n+m}\).

La versión Turingniana del concepto de conjunto \(\Sigma\)-efectivamente computable es fácil de dar: un conjunto \(S\subseteq\omega^{n}\times\Sigma^{\ast m}\) será llamado \(\Sigma\)-Turing computable cuando la función \(\chi_{S}^{\omega^{n}\times\Sigma^{\ast m}}\) sea \(\Sigma\)-Turing computable. O sea que \(S\subseteq\omega^{n}\times\Sigma^{\ast m}\) es \(\Sigma\)-Turing computable sii hay una máquina de Turing con unit \(M=\left(Q,\Sigma,\Gamma,\delta,q_{0},B,\shortmid,F\right)\) la cual computa a \(\chi_{S}^{\omega^{n}\times\Sigma^{\ast m}}\), es decir:

adhocprefix-adhocsufix Si \((\vec{x},\vec{\alpha})\in S\), entonces hay un \(p\in Q\) tal que \[\left\lfloor q_{0}B\shortmid^{x_{1}}B...B\shortmid^{x_{n}}B\alpha_{1}B...B\alpha_{m}\right\rfloor \overset{\ast}{\vdash}\left\lfloor pB\shortmid\right\rfloor\] y \(\left\lfloor pB\shortmid\right\rfloor \nvdash d\), para cada \(d\in Des\)

adhocprefix-adhocsufix Si \((\vec{x},\vec{\alpha})\in(\omega^{n}\times\Sigma^{\ast m})-S\), entonces hay un \(p\in Q\) tal que \[\left\lfloor q_{0}B\shortmid^{x_{1}}B...B\shortmid^{x_{n}}B\alpha_{1}B...B\alpha_{m}\right\rfloor \overset{\ast}{\vdash}\left\lfloor pB\right\rfloor\] y \(\left\lfloor pB\right\rfloor \nvdash d\), para cada \(d\in Des\)

Si \(M\) es una máquina de Turing la cual computa a \(\chi_{S}^{\omega^{n}\times\Sigma^{\ast m}}\), diremos que \(M\) decide la pertenencia a \(S\), con respecto al conjunto \(\omega^{n}\times\Sigma^{\ast m}\).

En esta sección desarrollaremos el modelo matemático del concepto de función \(\Sigma\)-efectivamente computable, dado por Godel. Dichas funciones serán llamadas \(\Sigma\)-recursivas. La idea es partir de un conjunto inicial de funciones muy simples y obviamente \(\Sigma\)-efectivamente computables y luego obtener nuevas funciones \(\Sigma\)-efectivamente computables usando constructores que preservan la computabilidad efectiva. Las funciones \(\Sigma\)-recursivas serán las que se obtienen iterando el uso de estos constructores, partiendo del conjunto inicial de funciones antes mencionado. Nos referiremos a este paradigma como el paradigma Godeliano o recursivo. A veces también lo llamaremos el paradigma funcional.

La familia de funciones simples y obviamente \(\Sigma\)-efectivamente computables de la que partiremos es la siguiente \[\left\{ Suc,Pred,C_{0}^{0,0},C_{\varepsilon}^{0,0}\right\} \cup\left\{ d_{a}:a\in\Sigma\right\} \cup\left\{ p_{j}^{n,m}:1\leq j\leq n+m\right\}\] Los constructores que usaremos son:

adhocprefix-adhocsufix Composición

adhocprefix-adhocsufix Recursión primitiva

adhocprefix-adhocsufix Minimización de predicados \(\Sigma\)-totales

Estos constructores nos permiten dadas ciertas funciones construir o definir una nueva función y tienen la propiedad de preservar la computabilidad efectiva en el sentido que si las funciones iniciales son \(\Sigma\)-efectivamente computables, entonces la función obtenida también lo es. Un concepto fundamental es el de función \(\Sigma\)-recursiva primitiva. Estas funciones serán aquellas que se obtienen a partir de las del conjunto inicial usando solo los dos primeros constructores: composición y recursión primitiva. Nuestro primer objetivo es definir el concepto de función \(\Sigma\)-recursiva primitiva para lo cual en las próximas dos secciones definiremos y estudiaremos los constructores de composición y recursión primitiva. Luego definiremos el concepto de función \(\Sigma\)-recursiva primitiva y nos abocaremos a desarrollar este concepto fundamental. Recién después estudiaremos el constructor de Minimización y definiremos el concepto de función \(\Sigma\)-recursiva. La última parte de la sección esta destinada a probar un teorema que nos dice que los conceptos de función \(\Sigma\)-recursiva y \(\Sigma\)-recursiva primitiva son independientes del alfabeto \(\Sigma\).

Dadas funciones \(\Sigma\)-mixtas \(f,f_{1},...,f_{r}\), con \(r\geq1\), diremos que la función \(f\circ[f_{1},...,f_{r}]\) es obtenida por composición a partir de las funciones \(f,f_{1},...,f_{r}\). Para probar que la composición preserva la computabilidad efectiva necesitaremos el siguiente lema.

4.1 (Composición no Vacía). Supongamos que \(f,f_{1},...,f_{r}\) son funciones \(\Sigma\)-mixtas, con \(r\geq1\). Supongamos además que \(f\circ[f_{1},...,f_{r}]\neq\emptyset\). Entonces hay \(n,m,k,l\in\omega\) y \(s\in\{\#,\ast\}\) tales que

adhocprefix-adhocsufix \(r=n+m\)

adhocprefix-adhocsufix \(f\) es de tipo \((n,m,s)\)

adhocprefix-adhocsufix \(f_{i}\) es de tipo \((k,l,\#)\), para cada \(i=1,...,n\)

adhocprefix-adhocsufix \(f_{i}\) es de tipo \((k,l,\ast)\), para cada \(i=n+1,...,n+m\)

Mas aun, en tal caso la función \(f\circ[f_{1},...,f_{n+m}]\) es de tipo \((k,l,s)\) y: \[\begin{aligned} D_{f\circ[f_{1},...,f_{n+m}]} & =\left\{ (\vec{x},\vec{\alpha})\in\bigcap_{i=1}^{n+m}D_{f_{i}}:(f_{1}(\vec{x},\vec{\alpha}),...,f_{n+m}(\vec{x},\vec{\alpha}))\in D_{f}\right\} \\ f\circ[f_{1},...,f_{n+m}](\vec{x},\vec{\alpha}) & =f(f_{1}(\vec{x},\vec{\alpha}),...,f_{n+m}(\vec{x},\vec{\alpha})). \end{aligned}\]

Proof. Nótese que \(f\neq\emptyset\) y \([f_{1},...,f_{r}]\neq\emptyset\) (por que?). Además \(f_{i}\neq\emptyset\), para cada \(i=1,...,r\) (por que?). Ya que \(f\neq\emptyset\) tenemos que hay únicos \(n,m\in\omega\) y \(s\in\{\#,\ast\}\) tales que \(f\) es de tipo \((n,m,s)\). Ya que \(f\circ[f_{1},...,f_{r}]\neq\emptyset\) y \(I_{[f_{1},...,f_{r}]}\subseteq I_{f_{1}}\times...\times I_{f_{r}}\), tenemos que

adhocprefix-adhocsufix \(r=n+m\)

adhocprefix-adhocsufix \(I_{f_{i}}\subseteq\omega\), para cada \(i=1,...,n\)

adhocprefix-adhocsufix \(I_{f_{i}}\subseteq\Sigma^{\ast}\), para cada \(i=n+1,...,n+m\)

Ya que \([f_{1},...,f_{r}]\neq\emptyset\) tenemos que \(D_{[f_{1},...,f_{r}]}=\bigcap_{i=1}^{r}D_{f_{i}}\neq\emptyset\), por lo cual los conjuntos \(D_{f_{1}},...,D_{f_{n+m}}\) deberán ser todos de un mismo tipo, digamos de tipo \((k,l)\). Es decir que \(f_{i}\) es de tipo \((k,l,\#)\), para cada \(i=1,...,n\) y \(f_{i}\) es de tipo \((k,l,\ast)\), para cada \(i=n+1,...,n+m\).

Las últimas observaciones del lema son directas de las definiciones de \([f_{1},...,f_{n+m}]\) y de composición de funciones

Ahora sí podemos probar fácilmente que el constructor composición preserva la computabilidad efectiva

4.2. Si \(f,f_{1},...,f_{r}\), con \(r\geq1\), son \(\Sigma\)-efectivamente computables, entonces \(f\circ[f_{1},...,f_{r}]\) lo es.

Proof. Si \(f\circ[f_{1},...,f_{r}]=\emptyset\), entonces claramente es \(\Sigma\)-efectivamente computable. Supongamos entonces que \(f\circ[f_{1},...,f_{r}]\neq\emptyset\). Por el lema anterior hay \(n,m,k,l\in\omega\) y \(s\in\{\#,\ast\}\) tales que

adhocprefix-adhocsufix \(r=n+m\)

adhocprefix-adhocsufix \(f\) es de tipo \((n,m,s)\)

adhocprefix-adhocsufix \(f_{i}\) es de tipo \((k,l,\#)\), para cada \(i=1,...,n\)

adhocprefix-adhocsufix \(f_{i}\) es de tipo \((k,l,\ast)\), para cada \(i=n+1,...,n+m\)

Sean \(\mathbb{P},\mathbb{P}_{1},...,\mathbb{P}_{n+m}\) procedimientos efectivos los cuales computen computen las funciones \(f,f_{1},...,f_{n+m}\), respectivamente. Usando estos procedimientos es fácil definir un procedimiento efectivo el cual compute a \(f\circ[f_{1},...,f_{n+m}]\).

La recursión primitiva es un tipo muy particular de recursión. Consideremos por ejemplo las siguientes ecuaciones:

adhocprefix(1)adhocsufix \(R(0)=1\)

adhocprefix(2)adhocsufix \(R(t+1)=1+R(t)+R(t)^{2}\)

Nótese que hay una única función \(R:\omega\rightarrow\omega\) la cual cumple (1) y (2). Esto es ya que el valor de \(R\) en \(t\) esta determinado por sucesivas aplicaciones de las ecuaciones (1) y (2). Por ejemplo la ecuación (1) nos dice que \(R(0)=1\) pero entonces la ecuación (2) nos dice que \(R(1)=1+1+1^{2}=3\) por lo cual nuevamente la ecuación (2) nos dice que \(R(2)=1+3+3^{2}=13\) y así podemos notar fácilmente que \(R\) esta determinada por dichas ecuaciones.

Se suele decir que las ecuaciones (1) y (2) definen recursivamente a la función \(R\) pero hay que tener cuidado porque esto es una manera de hablar ya que la función \(R\) podría en nuestro discurso ya haber sido definida de otra manera. Mas propio es pensar que dichas ecuaciones determinan a \(R\) en el sentido que \(R\) es la única que las cumple. Por ejemplo las ecuaciones:

adhocprefix(a)adhocsufix \(R(0)=50\)

adhocprefix(b)adhocsufix \(R(t+1)=R(t)\)

“definen recursivamente” a la función \(C_{50}^{1,0}\) pero esta claro que la definición de \(C_{50}^{1,0}\) en esta materia no fue dada de esta forma.

Hay casos de recursiones en las cuales el valor de \(R(t+1)\) no solo depende de \(R(t)\) sino que también depende de \(t\). Por ejemplo

adhocprefix(i)adhocsufix \(R(0)=1\)

adhocprefix(ii)adhocsufix \(R(t+1)=t.R(t)+1\)

De todas maneras debería quedar claro que las ecuaciones (i) y (ii) determinan una única función \(R:\omega\rightarrow\omega\) que las satisface.

También podemos generalizar pensando que la función \(R\) depende no solo de un parámetro \(t\) sino que su dominio es \(\omega^{4}\), es decir depende de \(t\) y \(x_{1},x_{2},x_{3}\). Por ejemplo

adhocprefix(p)adhocsufix \(R(0,x_{1},x_{2},x_{3})=x_{1}+2x_{3}\)

adhocprefix(q)adhocsufix \(R(t+1,x_{1},x_{2},x_{3})=t+x_{1}+x_{2}+x_{3}+R(t,x_{1},x_{2},x_{3})\)

Dejamos al lector convencerse de que (p) y (q) son cumplidas por una única función \(R:\omega^{4}\rightarrow\omega\). También podríamos tener variables alfabéticas. Por ejemplo consideremos

adhocprefix(r)adhocsufix \(R(0,x_{1},x_{2},\alpha_{1},\alpha_{2})=x_{1}+\left\vert \alpha_{1}\right\vert ^{x_{2}}\)

adhocprefix(s)adhocsufix \(R(t+1,x_{1},x_{2},\alpha_{1},\alpha_{2})=t+x_{1}+x_{2}+\left\vert \alpha_{1}\right\vert +\left\vert \alpha_{2}\right\vert +R(t,x_{1},x_{2},\alpha_{1},\alpha_{2})\)

Es claro aquí que las ecuaciones (r) y (s) determinan una única función \(R:\omega^{3}\times\Sigma^{\ast2}\rightarrow\omega\) que las cumple. Esto se puede explicar de la siguiente manera:

adhocprefix-adhocsufix La ecuación (r) determina los valores de \(R\) sobre el conjunto \(\{0\}\times\omega\times\omega\times\Sigma^{\ast}\times\Sigma^{\ast}\). Pero una ves determinados estos valores, la ecuación (s) tomada con \(t=0\), determina los valores de \(R\) sobre el conjunto \(\{1\}\times\omega\times\omega\times\Sigma^{\ast}\times\Sigma^{\ast}\). Pero una ves determinados estos valores, la ecuación (s) tomada con \(t=1\), determina los valores de \(R\) sobre el conjunto \(\{2\}\times\omega\times\omega\times\Sigma^{\ast}\times\Sigma^{\ast}\), etc

El caso anterior podría generalizarse de la siguiente manera: Si tenemos dadas dos funciones \[\begin{aligned} f & :\omega^{n}\times\Sigma^{\ast m}\rightarrow\omega\\ g & :\omega^{n+2}\times\Sigma^{\ast m}\rightarrow\omega \end{aligned}\] entonces las ecuaciones:

adhocprefix(a)adhocsufix \(R(0,\vec{x},\vec{\alpha})=f(\vec{x},\vec{\alpha})\)

adhocprefix(b)adhocsufix \(R(t+1,\vec{x},\vec{\alpha})=g(R(t,\vec{x},\vec{\alpha}),t,\vec{x},\vec{\alpha})\)

determinan una única función \(R:\omega^{n+1}\times\Sigma^{\ast m}\rightarrow\omega\) que las cumple. Nótese que para el caso \[\begin{aligned} n & =m=2\\ f & =\lambda x_{1}x_{2}\alpha_{1}\alpha_{2}[x_{1}+\left\vert \alpha_{1}\right\vert ^{x_{2}}]\\ g & =\lambda xtx_{1}x_{2}\alpha_{1}\alpha_{2}[t+x_{1}+x_{2}+\left\vert \alpha_{1}\right\vert +\left\vert \alpha_{2}\right\vert +x] \end{aligned}\] las ecuaciones (a) y (b) se transforman en las ecuaciones (r) y (s).

El primer caso de recursión primitiva que definiremos a continuación engloba los ejemplos vistos recién dentro de un marco general.

Supongamos tenemos dadas funciones \[\begin{aligned} f & :S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\rightarrow\omega\\ g & :\omega\times\omega\times S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\rightarrow\omega \end{aligned}\] con \(S_{1},...,S_{n}\subseteq\omega\) y \(L_{1},...,L_{m}\subseteq\Sigma^{\ast}\) conjuntos no vacíos. Usando el razonamiento inductivo usado en los ejemplos anteriores, se puede probar que hay una única función \[R:\omega\times S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\rightarrow\omega\] la cual cumple las ecuaciones

adhocprefix-adhocsufix \(R(0,\vec{x},\vec{\alpha})=f(\vec{x},\vec{\alpha})\)

adhocprefix-adhocsufix \(R(t+1,\vec{x},\vec{\alpha})=g(R(t,\vec{x},\vec{\alpha}),t,\vec{x},\vec{\alpha})\)

Llamaremos \(R(f,g)\) a esta única función que cumple las ecuaciones anteriores. Resumiendo este hecho, diremos que las ecuaciones

adhocprefix(1)adhocsufix \(R(f,g)(0,\vec{x},\vec{\alpha})=f(\vec{x},\vec{\alpha})\)

adhocprefix(2)adhocsufix \(R(f,g)(t+1,\vec{x},\vec{\alpha})=g(R(f,g)(t,\vec{x},\vec{\alpha}),t,\vec{x},\vec{\alpha})\)

definen recursivamente a la función \(R(f,g)\). También diremos que \(R(f,g)\) es obtenida por recursión primitiva a partir de \(f\) y \(g\).

NOTA IMPORTANTE: No confundirse y pensar que \(R(f,g)\) es el resultado de aplicar una función \(R\) al par \((f,g)\), de hecho hasta el momento no hemos definido ninguna función \(R\) cuyo dominio sea cierto conjunto de pares ordenados de funciones!

Nótese que cuando \(m=n=0\), se tiene que \(D_{f}=\{\lozenge\}\) y (1) y (2) se transforman en

adhocprefix(1)adhocsufix \(R(f,g)(0)=f(\lozenge)\)

adhocprefix(2)adhocsufix \(R(f,g)(t+1)=g(R(f,g)(t),t)\)

Veamos algunos ejemplos

adhocprefix(E1)adhocsufix Tomemos \(f=p_{1}^{1,0}\) y \(g=Suc\circ p_{1}^{3,0}\). De la definición de \(R(f,g)\), obtenemos que su dominio es \(\omega^{2}\) y \[\begin{aligned} R(f,g)(0,x_{1}) & =p_{1}^{1,0}(x_{1})=x_{1}\\ R(f,g)(t+1,x_{1}) & =\left(Suc\circ p_{1}^{3,0}\right)(R(f,g)(t,x_{1}),t,x_{1})=R(f,g)(t,x_{1})+1 \end{aligned}\] Es fácil notar que la única función que cumple estas dos ecuaciones es \(\lambda tx_{1}\left[t+x_{1}\right]\), lo cual implica que \(\lambda tx_{1}\left[t+x_{1}\right]=R\left(p_{1}^{1,0},Suc\circ p_{1}^{3,0}\right)\)

adhocprefix(E2)adhocsufix Sean \(f=C_{0}^{0,0}\) y \(g=p_{1}^{2,0}\). De la definición de \(R(f,g)\), obtenemos que su dominio es \(\omega\) y \[\begin{aligned} R(f,g)(0) & =C_{0}^{0,0}(\lozenge)=0\\ R(f,g)(t+1) & =p_{1}^{2,0}(R(f,g)(t),t)=R(f,g)(t) \end{aligned}\] Es fácil notar que la única función que cumple estas dos ecuaciones es \(C_{0}^{1,0}\) lo cual implica que \(C_{0}^{1,0}=R\left(C_{0}^{0,0},p_{1}^{2,0}\right)\)

Como era de esperar, este caso del constructor de recursión primitiva preserva la computabilidad efectiva

4.3. Sean \[\begin{aligned} f & :S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\rightarrow\omega\\ g & :\omega\times\omega\times S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\rightarrow\omega \end{aligned}\] con \(S_{1},...,S_{n}\subseteq\omega\) y \(L_{1},...,L_{m}\subseteq\Sigma^{\ast}\) conjuntos no vacíos. Si \(f\) y \(g\) son \(\Sigma\)-efectivamente computables, entonces \(R(f,g)\) lo es.

Proof. Sean \(\mathbb{P}_{f}\) y \(\mathbb{P}_{g}\) procedimientos efectivos que computan a \(f\) y \(g\), respectivamente. Es fácil construir entonces un procedimiento efectivo que compute a \(R(f,g)\).

Nota importante: En los ejemplos anteriores y en todos los casos que manejaremos en esta primera etapa, en las aplicaciones del constructor de recursión primitiva (en sus cuatro formas) las funciones iniciales serán \(\Sigma\)-totales (es decir \(S_{1}=...=S_{n}=\omega\) y \(L_{1}=...=L_{m}=\Sigma^{\ast}\)). Mas adelante veremos aplicaciones con funciones no \(\Sigma\)-totales.

Ahora haremos el caso en el que la función determinada recursivamente tiene imagen contenida en \(\Sigma^{\ast}\). Es claro que entonces \(f\) y \(g\) también deberán tener imagen contenida en \(\Sigma^{\ast}\). El único detalle a tener en cuenta en la definición de este caso es que si solo hiciéramos estos cambios y pusiéramos las mismas ecuaciones la función \(g\) no resultaría \(\Sigma\)-mixta en general. Para que la \(g\) de la recursión siga siendo \(\Sigma\)-mixta deberemos modificar levemente su dominio en relación al caso ya hecho

Supongamos \(\Sigma\) es un alfabeto finito. Sean \[\begin{aligned} f & :S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\rightarrow\Sigma^{\ast}\\ g & :\omega\times S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\times\Sigma^{\ast}\rightarrow\Sigma^{\ast} \end{aligned}\] con \(S_{1},...,S_{n}\subseteq\omega\) y \(L_{1},...,L_{m}\subseteq\Sigma^{\ast}\) conjuntos no vacíos. Definamos \[R(f,g):\omega\times S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\rightarrow\Sigma^{\ast}\] de la siguiente manera

adhocprefix(1)adhocsufix \(R(f,g)(0,\vec{x},\vec{\alpha})=f(\vec{x},\vec{\alpha})\)

adhocprefix(2)adhocsufix \(R(f,g)(t+1,\vec{x},\vec{\alpha})=g(t,\vec{x},\vec{\alpha},R(f,g)(t,\vec{x},\vec{\alpha}))\)

Diremos que \(R(f,g)\) es obtenida por recursión primitiva a partir de \(f\) y \(g\). Nótese que cuando \(m=n=0\), se tiene que \(D_{f}=\{\lozenge\}\) y (1) y (2) se transforman en

adhocprefix(1)adhocsufix \(R(f,g)(0)=f(\lozenge)\)

adhocprefix(2)adhocsufix \(R(f,g)(t+1)=g(t,R(f,g)(t))\)

Veamos algunos ejemplos

adhocprefix(E1)adhocsufix Tomemos \(f=C_{\varepsilon}^{0,1}\) y \(g=\lambda\alpha\beta\left[\alpha\beta\right]\circ\left[p_{3}^{1,2},p_{2}^{1,2}\right]\). De la definición de \(R(f,g)\), obtenemos que \[\begin{aligned} R(f,g)(0,\alpha_{1}) & =C_{\varepsilon}^{0,1}(\alpha_{1})=\varepsilon\\ R(f,g)(t+1,\alpha_{1}) & =\lambda\alpha\beta\left[\alpha\beta\right]\circ\left[p_{3}^{1,2},p_{2}^{1,2}\right](t,\alpha_{1},R(f,g)(t,\alpha_{1}))=R(f,g)(t,\alpha_{1})\alpha_{1} \end{aligned}\] Es fácil notar que la única función que cumple estas dos ecuaciones es \(\lambda t\alpha_{1}\left[\alpha_{1}{}^{t}\right]\), lo cual implica que \(\lambda t\alpha_{1}\left[\alpha_{1}{}^{t}\right]=R\left(C_{\varepsilon}^{0,1},\lambda\alpha\beta\left[\alpha\beta\right]\circ\left[p_{3}^{1,2},p_{2}^{1,2}\right]\right)\)

adhocprefix(E2)adhocsufix Sean \(f=C_{\varepsilon}^{0,0}\) y \(g=p_{2}^{2,0}\). De la definición de \(R(f,g)\), obtenemos que \[\begin{aligned} R(f,g)(0) & =C_{\varepsilon}^{0,0}(\lozenge)=\varepsilon\\ R(f,g)(t+1) & =p_{2}^{2,0}(t,R(f,g)(t))=R(f,g)(t) \end{aligned}\] Es fácil notar que la única función que cumple estas dos ecuaciones es \(C_{\varepsilon}^{1,0}\) lo cual implica que \(C_{\varepsilon}^{1,0}=R\left(C_{\varepsilon}^{0,0},p_{2}^{2,0}\right)\)

La prueba del siguiente lema es completamente análoga a la del lema anterior que fue dejada como ejercicio.

4.4. Sean \[\begin{aligned} f & :S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\rightarrow\Sigma^{\ast}\\ g & :\omega\times S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\times\Sigma^{\ast}\rightarrow\Sigma^{\ast} \end{aligned}\] con \(S_{1},...,S_{n}\subseteq\omega\) y \(L_{1},...,L_{m}\subseteq\Sigma^{\ast}\) conjuntos no vacíos. Si \(f\) y \(g\) son \(\Sigma\)-efectivamente computables, entonces \(R(f,g)\) lo es.

Ya vimos dos casos de recursión donde el parámetro que comanda la recursión es numérico. Daremos a continuación un ejemplo de recursión en el cual el parámetro principal es alfabético. Sea \(\Sigma=\{\%,@,?\}\) y consideremos las siguientes ecuaciones:

adhocprefix(1)adhocsufix \(R(\varepsilon)=15\)

adhocprefix(2)adhocsufix \(R(\alpha\%)=R(\alpha)+1\)

adhocprefix(3)adhocsufix \(R(\alpha@)=R(\alpha).5\)

adhocprefix(4)adhocsufix \(R(\alpha?)=R(\alpha)^{20}\)

Nótese que las ecuaciones anteriores determinan una función \(R:\Sigma^{\ast}\rightarrow\omega\). Esto es ya que \(R\) en \(\varepsilon\) debe valer \(15\) y sabiendo esto las ecuaciones (2), (3) y (4) (con \(\alpha=\varepsilon\)) nos dicen que \[\begin{aligned} R(\%) & =16\\ R(@) & =75\\ R(?) & =15^{20} \end{aligned}\] por lo cual podemos aplicarlas nuevamente a dichas ecuaciones (con \(\alpha\in\{\%,@,?\}\)) para calcular \(R\) en todas las palabras de longitud \(2\); y así sucesivamente.

Daremos otro ejemplo un poco mas complicado para seguir aproximándonos al caso general. Nuevamente supongamos que \(\Sigma=\{\%,@,?\}\) y supongamos tenemos una función \[f:\omega\times\Sigma^{\ast}\rightarrow\omega\] y tres funciones \[\begin{aligned} \mathcal{G}_{\%} & :\omega\times\omega\times\Sigma^{\ast}\times\Sigma^{\ast}\rightarrow\omega\\ \mathcal{G}_{@} & :\omega\times\omega\times\Sigma^{\ast}\times\Sigma^{\ast}\rightarrow\omega\\ \mathcal{G}_{?} & :\omega\times\omega\times\Sigma^{\ast}\times\Sigma^{\ast}\rightarrow\omega \end{aligned}\] Entonces hay una única función \(R:\omega\times\Sigma^{\ast}\times\Sigma^{\ast}\rightarrow\omega\) la cual cumple las siguientes ecuaciones

adhocprefix(1)adhocsufix \(R(x_{1},\alpha_{1},\varepsilon)=f(x_{1},\alpha_{1})\)

adhocprefix(2)adhocsufix \(R(x_{1},\alpha_{1},\alpha\%)=\mathcal{G}_{\%}(R(x_{1},\alpha_{1},\alpha),x_{1},\alpha_{1},\alpha)\)

adhocprefix(3)adhocsufix \(R(x_{1},\alpha_{1},\alpha@)=\mathcal{G}_{@}(R(x_{1},\alpha_{1},\alpha),x_{1},\alpha_{1},\alpha)\)

adhocprefix(4)adhocsufix \(R(x_{1},\alpha_{1},\alpha?)=\mathcal{G}_{?}(R(x_{1},\alpha_{1},\alpha),x_{1},\alpha_{1},\alpha)\)

(Justifique que las ecuaciones anteriores determinan a la función \(R\).)

El ejemplo anterior nos muestra que para hacer recursión sobre parámetro alfabético nos hace falta "una función \(g\) por cada símbolo de \(\Sigma\)". Esto motiva la siguiente definición. Dado un alfabeto \(\Sigma\), una familia \(\Sigma\)-indexada de funciones será una función \(\mathcal{G}\) tal que \(D_{\mathcal{G}}=\Sigma\) y para cada \(a\in D_{\mathcal{G}}\) se tiene que \(\mathcal{G}(a)\) es una función. Algunos ejemplos:

adhocprefix(E1)adhocsufix Sea \(\mathcal{G}\) dada por \[\begin{array}{rcl} \mathcal{G}:\{\square,\%,\blacktriangle\} & \rightarrow & \{Suc,Pred\}\\ \square & \rightarrow & Suc\\ \% & \rightarrow & Suc\\ \blacktriangle & \rightarrow & Pred \end{array}\] Claramente \(\mathcal{G}\) es una familia \(\{\square,\%,\blacktriangle\}\)-indexada de funciones. Notar que \[\mathcal{G}=\{(\square,Suc),(\%,Suc),(\blacktriangle,Pred)\}\] Se tiene también por ejemplo que \(\mathcal{G}(\%)=Suc\) por lo cual también es cierto que \(\mathcal{G}(\%)(22)=23\), etc.

adhocprefix(E2)adhocsufix Si \(\Sigma\) es un alfabeto no vacío, la función \[\begin{array}{rcl} \mathcal{G}:\Sigma & \rightarrow & \{f:f\text{ es una función de }\Sigma^{\ast}\text{ en }\Sigma^{\ast}\}\\ a & \rightarrow & d_{a} \end{array}\] es una familia \(\Sigma\)-indexada de funciones. Notar que \[\mathcal{G}=\{(a,d_{a}):a\in\Sigma\}\]

adhocprefix(E3)adhocsufix \(\emptyset\) es una flia \(\emptyset\)-indexada de funciones

Si \(\mathcal{G}\) es una familia \(\Sigma\)-indexada de funciones, entonces para \(a\in\Sigma\), escribiremos \(\mathcal{G}_{a}\) en lugar de \(\mathcal{G}(a)\). Ahora sí, nuestro caso de recursión primitiva. Sea \[f:S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\rightarrow\omega\] con \(S_{1},...,S_{n}\subseteq\omega\) y \(L_{1},...,L_{m}\subseteq\Sigma^{\ast}\) conjuntos no vacíos y sea \(\mathcal{G}\) una familia \(\Sigma\)-indexada de funciones tal que \[\mathcal{G}_{a}:\omega\times S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\times\Sigma^{\ast}\rightarrow\omega\] para cada \(a\in\Sigma.\) Definamos \[R(f,\mathcal{G}):S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\times\Sigma^{\ast}\rightarrow\omega\] de la siguiente manera

adhocprefix(1)adhocsufix \(R(f,\mathcal{G})(\vec{x},\vec{\alpha},\varepsilon)=f(\vec{x},\vec{\alpha})\)

adhocprefix(2)adhocsufix \(R(f,\mathcal{G})(\vec{x},\vec{\alpha},\alpha a)=\mathcal{G}_{a}(R(f,\mathcal{G})(\vec{x},\vec{\alpha},\alpha),\vec{x},\vec{\alpha},\alpha)\)

Diremos que \(R(f,\mathcal{G})\) es obtenida por recursión primitiva a partir de \(f\) y \(\mathcal{G}\). Nótese que cuando \(m=n=0\), se tiene que \(D_{f}=\{\lozenge\}\) y (1) y (2) se transforman en

adhocprefix(1)adhocsufix \(R(f,\mathcal{G})(\varepsilon)=f(\lozenge)\)

adhocprefix(2)adhocsufix \(R(f,\mathcal{G})(\alpha a)=\mathcal{G}_{a}(R(f,\mathcal{G})(\alpha),\alpha)\)

4.5. Sea \[f:S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\rightarrow\omega\] con \(S_{1},...,S_{n}\subseteq\omega\) y \(L_{1},...,L_{m}\subseteq\Sigma^{\ast}\) conjuntos no vacíos y sea \(\mathcal{G}\) una familia \(\Sigma\)-indexada de funciones tal que \[\mathcal{G}_{a}:\omega\times S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\times\Sigma^{\ast}\rightarrow\omega\] para cada \(a\in\Sigma.\) Si \(f\) y cada \(\mathcal{G}_{a}\) son \(\Sigma\)-efectivamente computables, entonces \(R(f,\mathcal{G})\) lo es.

Proof. Es dejada al lector

Supongamos \(\Sigma\) es un alfabeto finito. Sea \[f:S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\rightarrow\Sigma^{\ast}\] con \(S_{1},...,S_{n}\subseteq\omega\) y \(L_{1},...,L_{m}\subseteq\Sigma^{\ast}\) conjuntos no vacíos y sea \(\mathcal{G}\) una familia \(\Sigma\)-indexada de funciones tal que \[\mathcal{G}_{a}:S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\times\Sigma^{\ast}\times\Sigma^{\ast}\rightarrow\Sigma^{\ast}\] para cada \(a\in\Sigma\). Definamos \[R(f,\mathcal{G}):S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\times\Sigma^{\ast}\rightarrow\Sigma^{\ast}\] de la siguiente manera

adhocprefix(1)adhocsufix \(R(f,\mathcal{G})(\vec{x},\vec{\alpha},\varepsilon)=f(\vec{x},\vec{\alpha})\)

adhocprefix(2)adhocsufix \(R(f,\mathcal{G})(\vec{x},\vec{\alpha},\alpha a)=\mathcal{G}_{a}(\vec{x},\vec{\alpha},\alpha,R(f,\mathcal{G})(\vec{x},\vec{\alpha},\alpha)).\)

Diremos que \(R(f,\mathcal{G})\) es obtenida por recursión primitiva a partir de \(f\) y \(\mathcal{G}\). Nótese que cuando \(m=n=0\), se tiene que \(D_{f}=\{\lozenge\}\) y (1) y (2) se transforman en

adhocprefix(1)adhocsufix \(R(f,\mathcal{G})(\varepsilon)=f(\lozenge)\)

adhocprefix(2)adhocsufix \(R(f,\mathcal{G})(\alpha a)=\mathcal{G}_{a}(\alpha,R(f,\mathcal{G})(\alpha))\)

Tenemos que

4.6. Sea \[f:S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\rightarrow\Sigma^{\ast}\] con \(S_{1},...,S_{n}\subseteq\omega\) y \(L_{1},...,L_{m}\subseteq\Sigma^{\ast}\) conjuntos no vacíos y sea \(\mathcal{G}\) una familia \(\Sigma\)-indexada de funciones tal que \[\mathcal{G}_{a}:S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\times\Sigma^{\ast}\times\Sigma^{\ast}\rightarrow\Sigma^{\ast}\] para cada \(a\in\Sigma\). Si \(f\) y cada \(\mathcal{G}_{a}\) son \(\Sigma\)-efectivamente computables, entonces \(R(f,\mathcal{G})\) lo es.

Como hemos visto muchas veces para poder aplicar mas naturalmente algún lema, nos es útil cambiar las variables que están siendo usadas en la notación lambda que describe alguna función. Por ejemplo si queremos ver que la función \(\lambda xy\alpha[x+y]\) es de la forma \(R(f,g)\), con \(f\) de tipo \((1,1,\#)\) y \(g\) de tipo \((3,1,\#)\), nos conviene escribir a la función \(\lambda xy\alpha[x+y]\) en la forma \(\lambda tx_{1}\alpha_{1}[t+x_{1}]\), donde se ve mejor cual es el parámetro de la recursión primitiva y cual es el bloque fijo. Obviamente esto es posible ya que \(\lambda xy\alpha[x+y]=\lambda tx_{1}\alpha_{1}[t+x_{1}]\). Esto da lugar a nuestra regla de cosmética:

REGLA DE COSMÉTICA: Si Ud tiene una expresión lambda \(\lambda x_{1}...x_{n}\alpha_{1}...\alpha_{m}\left[E\right]\) que denota una función \(f\), entonces puede reemplazar en dicha expresión cada ocurrencia de una de las variables de la lista \(x_{1}...x_{n}\alpha_{1}...\alpha_{m}\) por una nueva variable (del mismo tipo, i.e. numérica o alfabética) la cual no figure en la lista y el resultado será una expresión lambda que también denota a \(f.\)

Por supuesto que dicha regla la puede aplicar varias veces para modificar su notación lambda. Por ejemplo en el caso de \(\lambda xy\alpha[x+y]\) aplicamos tres veces la regla y obtenemos \(\lambda tx_{1}\alpha_{1}[t+x_{1}]\).

Intuitivamente hablando una función es \(\Sigma\)-recursiva primitiva si se puede obtener de las iniciales usando los constructores de composición y recursión primitiva. Daremos ahora una definición matemática de este concepto. Definamos los conjuntos \(\mathrm{PR}_{0}^{\Sigma}\subseteq\mathrm{PR}_{1}^{\Sigma}\subseteq\mathrm{PR}_{2}^{\Sigma}\subseteq...\subseteq\mathrm{PR}^{\Sigma}\) de la siguiente manera \[\begin{array}{lll} \mathrm{PR}_{0}^{\Sigma} & = & \left\{ Suc,Pred,C_{0}^{0,0},C_{\varepsilon}^{0,0}\right\} \cup\left\{ d_{a}:a\in\Sigma\right\} \cup\left\{ p_{j}^{n,m}:1\leq j\leq n+m\right\} \\ \mathrm{PR}_{k+1}^{\Sigma} & = & \mathrm{PR}_{k}^{\Sigma}\cup\left\{ f\circ[f_{1},...,f_{r}]:f,f_{1},...,f_{r}\in\mathrm{PR}_{k}^{\Sigma}\text{, }r\geq1\right\} \cup\\ & & \;\;\;\;\left\{ R(f,\mathcal{G}):R(f,\mathcal{G})\text{ está definida y }\{f\}\cup\{\mathcal{G}_{a}:a\in\Sigma\}\subseteq\mathrm{PR}_{k}^{\Sigma}\right\} \cup\\ & & \;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\left\{ R(f,g):R(f,g)\text{ está definida y }f,g\in\mathrm{PR}_{k}^{\Sigma}\right\} \\ \mathrm{PR}^{\Sigma} & = & \bigcup_{k\geq0}\mathrm{PR}_{k}^{\Sigma} \end{array}\] Una función es llamada \(\Sigma\)-recursiva primitiva (\(\Sigma\)-p.r.) si pertenece a \(\mathrm{PR}^{\Sigma}\).

4.3. Si \(F\in\mathrm{PR}^{\Sigma}\), entonces \(F\) es \(\Sigma\)-efectivamente computable.

Proof. Lo probaremos usando la Regla de Inducción desde 0. Para cada \(k\in\omega\) sea \(\mathrm{Enu}_{k}\) el siguiente enunciado:

adhocprefix\(\mathrm{Enu}_{k}\):adhocsufix Si \(F\in\mathrm{PR}_{k}^{\Sigma}\), entonces \(F\) es \(\Sigma\)-efectivamente computable.

Es claro que si todos los enuciados \(\mathrm{Enu}_{k}\) son verdaderos, entonces la proposición lo es. Claramente \(\mathrm{Enu}_{0}\) es verdadero. Supongamos entonces que \(\mathrm{Enu}_{k}\) es verdadero y probemos que \(\mathrm{Enu}_{k+1}\) lo es. Sea \(F\in\mathrm{PR}_{k+1}^{\Sigma}\). Si \(F\in\mathrm{PR}_{k}^{\Sigma}\), entonces \(\mathrm{Enu}_{k}\) nos garantiza que \(F\) es \(\Sigma\)-efectivamente computable. Supongamos entonces que \(F\in\mathrm{PR}_{k+1}^{\Sigma}-\mathrm{PR}_{k}^{\Sigma}\). Por definición de \(\mathrm{PR}_{k+1}^{\Sigma}\) tenemos que \(F\) se obtiene usando los constructores de composición y recursión primitiva a partir de funciones de \(\mathrm{PR}_{k}^{\Sigma}\). Pero \(\mathrm{Enu}_{k}\) nos garantiza que dichas funciones son \(\Sigma\)-efectivamente computables por lo cual los Lemas 4.3, 4.4, 4.5, 4.6 y 4.2 nos dicen que siempre \(F\) será \(\Sigma\)-efectivamente computable.

En los siguientes lemas se prueba que varias funciones bien conocidas son \(\Sigma\)-recursivas primitivas.

4.7. Sea \(\Sigma\) un alfabeto finito.

adhocprefix(1)adhocsufix \(\emptyset\in\mathrm{PR}^{\Sigma}\).

adhocprefix(2)adhocsufix \(\lambda xy\left[x+y\right]\in\mathrm{PR}^{\Sigma}\).

adhocprefix(3)adhocsufix \(\lambda xy\left[x.y\right]\in\mathrm{PR}^{\Sigma}\).

adhocprefix(4)adhocsufix \(\lambda x\left[x!\right]\in\mathrm{PR}^{\Sigma}\).

Proof. (1) Nótese que \(\emptyset=Pred\circ C_{0}^{0,0}\in\mathrm{PR}_{1}^{\Sigma}\)

(2) Notar que \[\begin{aligned} \lambda xy\left[x+y\right](0,x_{1}) & =x_{1}=p_{1}^{1,0}(x_{1})\\ \lambda xy\left[x+y\right](t+1,x_{1}) & =\lambda xy\left[x+y\right](t,x_{1})+1\\ & =\left(Suc\circ p_{1}^{3,0}\right)\left(\lambda xy\left[x+y\right](t,x_{1}),t,x_{1}\right) \end{aligned}\] lo cual implica que \(\lambda xy\left[x+y\right]=R\left(p_{1}^{1,0},Suc\circ p_{1}^{3,0}\right)\in\mathrm{PR}_{2}^{\Sigma}.\)

(3) Primero note que \[\begin{aligned} C_{0}^{1,0}(0) & =C_{0}^{0,0}(\lozenge)\\ C_{0}^{1,0}(t+1) & =C_{0}^{1,0}(t) \end{aligned}\] lo cual implica que \(C_{0}^{1,0}=R\left(C_{0}^{0,0},p_{1}^{2,0}\right)\in\mathrm{PR}_{1}^{\Sigma}.\) También note que \[\lambda tx\left[t.x\right]=R\left(C_{0}^{1,0},\lambda xy\left[x+y\right]\circ\left[p_{1}^{3,0},p_{3}^{3,0}\right]\right),\] lo cual por (2) implica que \(\lambda tx\left[t.x\right]\in\mathrm{PR}_{4}^{\Sigma}\).

(4) Note que \[\begin{aligned} \lambda x\left[x!\right](0) & =1=C_{1}^{0,0}(\lozenge)\\ \lambda x\left[x!\right](t+1) & =\lambda x\left[x!\right](t).(t+1), \end{aligned}\] lo cual implica que \[\lambda x\left[x!\right]=R\left(C_{1}^{0,0},\lambda xy\left[x.y\right]\circ\left[p_{1}^{2,0},Suc\circ p_{2}^{2,0}\right]\right).\] Ya que \(C_{1}^{0,0}=\) \(Suc\circ C_{0}^{0,0}\), tenemos que \(C_{1}^{0,0}\in\mathrm{PR}_{1}^{\Sigma}\). Por (3), tenemos que \[\lambda xy\left[x.y\right]\circ\left[p_{1}^{2,0},Suc\circ p_{2}^{2,0}\right]\in\mathrm{PR}_{5}^{\Sigma},\] obteniendo que \(\lambda x\left[x!\right]\in\mathrm{PR}_{6}^{\Sigma}\).

Ahora consideraremos dos funciones las cuales son obtenidas naturalmente por recursión primitiva sobre variable alfabética.

4.8. Supongamos \(\Sigma\) es un alfabeto finito.

adhocprefix(a)adhocsufix \(\lambda\alpha\beta\left[\alpha\beta\right]\in\mathrm{PR}^{\Sigma}\)

adhocprefix(b)adhocsufix \(\lambda\alpha\left[\left\vert \alpha\right\vert \right]\in\mathrm{PR}^{\Sigma}\)

Proof. (a) Ya que \[\begin{aligned} \lambda\alpha\beta\left[\alpha\beta\right](\alpha_{1},\varepsilon) & =\alpha_{1}=p_{1}^{0,1}(\alpha_{1})\\ \lambda\alpha\beta\left[\alpha\beta\right](\alpha_{1},\alpha a) & =d_{a}(\lambda\alpha\beta\left[\alpha\beta\right](\alpha_{1},\alpha)),\ a\in\Sigma \end{aligned}\] tenemos que \(\lambda\alpha\beta\left[\alpha\beta\right]=R\left(p_{1}^{0,1},\mathcal{G}\right)\), donde \(\mathcal{G}_{a}=d_{a}\circ p_{3}^{0,3}\), para cada \(a\in\Sigma\).

(b) Ya que \[\begin{aligned} \lambda\alpha\left[\left\vert \alpha\right\vert \right](\varepsilon) & =0=C_{0}^{0,0}(\lozenge)\\ \lambda\alpha\left[\left\vert \alpha\right\vert \right](\alpha a) & =\lambda\alpha\left[\left\vert \alpha\right\vert \right](\alpha)+1 \end{aligned}\] tenemos que \(\lambda\alpha\left[\left\vert \alpha\right\vert \right]=R\left(C_{0}^{0,0},\mathcal{G}\right)\), donde \(\mathcal{G}_{a}=\) \(Suc\circ p_{1}^{1,1}\), para cada \(a\in\Sigma.\).

4.9. Sea \(\Sigma\) un alfabeto finito. Entonces \(C_{k}^{n,m},C_{\alpha}^{n,m}\in\mathrm{PR}^{\Sigma}\), para cada \(n,m,k\geq0\) y \(\alpha\in\Sigma^{\ast}\).

Proof. Note que \(C_{k+1}^{0,0}=\) \(Suc\circ C_{k}^{0,0}\), lo cual implica \(C_{k}^{0,0}\in\mathrm{PR}_{k}^{\Sigma}\), para \(k\geq0\). También note que \(C_{\alpha a}^{0,0}=d_{a}\circ C_{\alpha}^{0,0}\), lo cual dice que \(C_{\alpha}^{0,0}\in\mathrm{PR}^{\Sigma}\), para \(\alpha\in\Sigma^{\ast}\). Para ver que \(C_{k}^{0,1}\in\mathrm{PR}^{\Sigma}\) notar que \[\begin{aligned} C_{k}^{0,1}(\varepsilon) & =k=C_{k}^{0,0}(\lozenge)\\ C_{k}^{0,1}(\alpha a) & =C_{k}^{0,1}(\alpha)=p_{1}^{1,1}\left(C_{k}^{0,1}(\alpha),\alpha\right) \end{aligned}\] lo cual implica que \(C_{k}^{0,1}=R\left(C_{k}^{0,0},\mathcal{G}\right)\), con \(\mathcal{G}_{a}=p_{1}^{1,1}\), \(a\in\Sigma\). En forma similar podemos ver que \(C_{k}^{1,0},C_{\alpha}^{1,0},C_{\alpha}^{0,1}\in\mathrm{PR}^{\Sigma}\). Supongamos ahora que \(m>0\). Entonces \[\begin{aligned} C_{k}^{n,m} & =C_{k}^{0,1}\circ p_{n+1}^{n,m}\\ C_{\alpha}^{n,m} & =C_{\alpha}^{0,1}\circ p_{n+1}^{n,m} \end{aligned}\] de lo cual obtenemos que \(C_{k}^{n,m},C_{\alpha}^{n,m}\in\mathrm{PR}^{\Sigma}\). El caso \(n>0\) es similar.

4.10. Sea \(\Sigma\) un alfabeto finito.

adhocprefix(a)adhocsufix \(\lambda xy\left[x^{y}\right]\in\mathrm{PR}^{\Sigma}\).

adhocprefix(b)adhocsufix \(\lambda t\alpha\left[\alpha^{t}\right]\in\mathrm{PR}^{\Sigma}\).

Proof. (a) Note que \[\lambda tx\left[x^{t}\right]=R\left(C_{1}^{1,0},\lambda xy\left[x.y\right]\circ\left[p_{1}^{3,0},p_{3}^{3,0}\right]\right)\in\mathrm{PR}^{\Sigma}.\] O sea que \(\lambda xy\left[x^{y}\right]=\lambda tx\left[x^{t}\right]\circ\left[p_{2}^{2,0},p_{1}^{2,0}\right]\in\mathrm{PR}^{\Sigma}\).

(b) Note que \[\lambda t\alpha\left[\alpha^{t}\right]=R\left(C_{\varepsilon}^{0,1},\lambda\alpha\beta\left[\alpha\beta\right]\circ\left[p_{3}^{1,2},p_{2}^{1,2}\right]\right)\in\mathrm{PR}^{\Sigma}.\]

Ahora probaremos que si \(\Sigma\) es no vacío, entonces las biyecciones naturales entre \(\Sigma^{\ast}\) y \(\omega\), dadas en el Lema 2.3, son \(\Sigma\)-p.r..

4.11. Si \(\leq\) es un orden total sobre un alfabeto no vacío \(\Sigma\), entonces \(s^{\leq}\), \(\#^{\leq}\) y \(\ast^{\leq}\) pertenecen a \(\mathrm{PR}^{\Sigma}\)

Proof. Supongamos \(\Sigma=\{a_{1},...,a_{k}\}\) y \(\leq\) es dado por \(a_{1}<...<a_{k}\). Ya que \[\begin{aligned} s^{\leq}(\varepsilon) & =a_{1}\\ s^{\leq}(\alpha a_{i}) & =\alpha a_{i+1}\text{, para }i<k\\ s^{\leq}(\alpha a_{k}) & =s^{\leq}(\alpha)a_{1} \end{aligned}\] tenemos que \(s^{\leq}=R\left(C_{a_{1}}^{0,0},\mathcal{G}\right)\), donde \(\mathcal{G}_{a_{i}}=d_{a_{i+1}}\circ p_{1}^{0,2}\), para \(i=1,...,k-1\) y \(\mathcal{G}_{a_{k}}=d_{a_{1}}\circ p_{2}^{0,2}.\) O sea que \(s^{\leq}\in\mathrm{PR}^{\Sigma}.\) Ya que \[\begin{aligned} \ast^{\leq}(0) & =\varepsilon\\ \ast^{\leq}(t+1) & =s^{\leq}(\ast^{\leq}(t)) \end{aligned}\] podemos ver que \(\ast^{\leq}\in\mathrm{PR}^{\Sigma}\). Ya que \[\begin{aligned} \#^{\leq}(\varepsilon) & =0\\ \#^{\leq}(\alpha a_{i}) & =\#^{\leq}(\alpha).k+i\text{, para }i=1,...,k, \end{aligned}\] tenemos que \(\#^{\leq}=R\left(C_{0}^{0,0},\mathcal{G}\right)\), donde \[\mathcal{G}_{a_{i}}=\lambda xy\left[x+y\right]\circ\left[\lambda xy\left[x.y\right]\circ\left[p_{1}^{1,1},C_{k}^{1,1}\right],C_{i}^{1,1}\right]\text{, para }i=1,...,k\text{.}\] O sea que \(\#^{\leq}\in\mathrm{PR}^{\Sigma}\).

Recordemos que llamábamos numerales a los siguientes símbolos \[0\ 1\ 2\ 3\ 4\ 5\ 6\ 7\ 8\ 9\] También recordemos que \(Num\) denotaba el conjunto de los numerales. Sea \(Sig:Num^{\ast}\rightarrow Num^{\ast}\) definida de la siguiente manera \[\begin{aligned} Sig(\varepsilon) & =1\\ Sig(\alpha0) & =\alpha1\\ Sig(\alpha1) & =\alpha2\\ Sig(\alpha2) & =\alpha3\\ Sig(\alpha3) & =\alpha4\\ Sig(\alpha4) & =\alpha5\\ Sig(\alpha5) & =\alpha6\\ Sig(\alpha6) & =\alpha7\\ Sig(\alpha7) & =\alpha8\\ Sig(\alpha8) & =\alpha9\\ Sig(\alpha9) & =Sig(\alpha)0 \end{aligned}\] Definamos \(Dec:\omega\rightarrow Num^{\ast}\) de la siguiente manera \[\begin{aligned} Dec(0) & =\varepsilon\\ Dec(n+1) & =Sig(Dec(n)) \end{aligned}\] Nótese que para \(n\in\mathbf{N}\), la palabra \(Dec(n)\) es la notación usual decimal de \(n\). Nótese que \(Sig=R(C_{1}^{0,0},\mathcal{G})\), donde \(\mathcal{G}\) es la familia \(Num\)-indexada de funciones dada por: \[\begin{aligned} \mathcal{G}_{0}=d_{1}\circ p_{1}^{0,2}\\ \mathcal{G}_{1}=d_{2}\circ p_{1}^{0,2}\\ \mathcal{G}_{2}=d_{3}\circ p_{1}^{0,2}\\ \mathcal{G}_{3}=d_{4}\circ p_{1}^{0,2}\\ \mathcal{G}_{4}=d_{5}\circ p_{1}^{0,2}\\ \mathcal{G}_{5}=d_{6}\circ p_{1}^{0,2}\\ \mathcal{G}_{6}=d_{7}\circ p_{1}^{0,2}\\ \mathcal{G}_{7}=d_{8}\circ p_{1}^{0,2}\\ \mathcal{G}_{8}=d_{9}\circ p_{1}^{0,2}\\ \mathcal{G}_{9}=d_{0}\circ p_{2}^{0,2} \end{aligned}\] por lo cual \(Sig\) es \(Num\)-p.r.. También tenemos que \(Dec=R(C_{\varepsilon}^{0,0},Sig\circ p_{2}^{1,1})\) por lo cual \(Dec\) es \(Num\)-p.r.. En la batalla Godel vence a Neumann utilizaremos el siguiente resultado.

4.12. Sea \(\Gamma\) un alfabeto que contiene a \(Num\). Entonces \(Dec\) es \(\Gamma\)-p.r..

Proof. Sea \(\widetilde{Sig}:\Gamma^{*}\rightarrow\Gamma^{*}\) definida de la siguiente manera: \[\begin{aligned} \widetilde{Sig}(\varepsilon) & =1\\ \widetilde{Sig}(\alpha0) & =\alpha1\\ \widetilde{Sig}(\alpha1) & =\alpha2\\ \widetilde{Sig}(\alpha2) & =\alpha3\\ \widetilde{Sig}(\alpha3) & =\alpha4\\ \widetilde{Sig}(\alpha4) & =\alpha5\\ \widetilde{Sig}(\alpha5) & =\alpha6\\ \widetilde{Sig}(\alpha6) & =\alpha7\\ \widetilde{Sig}(\alpha7) & =\alpha8\\ \widetilde{Sig}(\alpha8) & =\alpha9\\ \widetilde{Sig}(\alpha9) & =Sig(\alpha)0\\ \widetilde{Sig}(\alpha a) & =\varepsilon\text{, para cada }a\in\Gamma-Num \end{aligned}\] Nótese que \(\widetilde{Sig}=R(C_{1}^{0,0},\mathcal{\widetilde{G}})\), donde \(\mathcal{\widetilde{G}}\) es la familia \(\Gamma\)-indexada de funciones dada por: \[\begin{aligned} \mathcal{\widetilde{G}}_{0}=d_{1}\circ p_{1}^{0,2}\\ \mathcal{\widetilde{G}}_{1}=d_{2}\circ p_{1}^{0,2}\\ \mathcal{\widetilde{G}}_{2}=d_{3}\circ p_{1}^{0,2}\\ \mathcal{\widetilde{G}}_{3}=d_{4}\circ p_{1}^{0,2}\\ \mathcal{\widetilde{G}}_{4}=d_{5}\circ p_{1}^{0,2}\\ \mathcal{\widetilde{G}}_{5}=d_{6}\circ p_{1}^{0,2}\\ \mathcal{\widetilde{G}}_{6}=d_{7}\circ p_{1}^{0,2}\\ \mathcal{\widetilde{G}}_{7}=d_{8}\circ p_{1}^{0,2}\\ \mathcal{\widetilde{G}}_{8}=d_{9}\circ p_{1}^{0,2}\\ \mathcal{\widetilde{G}}_{9}=d_{0}\circ p_{2}^{0,2}\\ \mathcal{\widetilde{G}}_{a}=C_{\varepsilon}^{0,2}\text{, para }a\in\Gamma-Num \end{aligned}\] por lo cual \(\widetilde{Sig}\) es \(\Gamma\)-p.r. (ojo que aquí las funciones \(p_{2}^{0,2}\), \(C_{\varepsilon}^{0,2}\), \(C_{1}^{0,0}\) y \(d_{0},d_{1},d_{2},...,d_{9}\) son relativas al alfabeto \(\Gamma\)). Pero nótese que \[\begin{aligned} Dec(0) & =\varepsilon\\ Dec(n+1) & =\widetilde{Sig}(Dec(n))\text{, para cada }n\in\omega \end{aligned}\] lo cual nos dice que \(Dec=R(C_{\varepsilon}^{0,0},\widetilde{Sig}\circ p_{2}^{1,1})\) por lo cual \(Dec\) es \(\Gamma\)-p.r. (de nuevo, aquí las funciones \(C_{\varepsilon}^{0,0}\) y \(p_{2}^{1,1}\) son relativas al alfabeto \(\Gamma\)).

Dados \(x,y\in\omega\), definamos \[x\dot{-}y=\max(x-y,0).\]

4.13. Sea \(\Sigma\) un alfabeto finito.

adhocprefix(a)adhocsufix \(\lambda xy\left[x\dot{-}y\right]\in\mathrm{PR}^{\Sigma}.\)

adhocprefix(b)adhocsufix \(\lambda xy\left[\max(x,y)\right]\in\mathrm{PR}^{\Sigma}.\)

adhocprefix(c)adhocsufix \(\lambda xy\left[x=y\right]\in\mathrm{PR}^{\Sigma}.\)

adhocprefix(d)adhocsufix \(\lambda xy\left[x\leq y\right]\in\mathrm{PR}^{\Sigma}.\)

adhocprefix(e)adhocsufix \(\lambda\alpha\beta\left[\alpha=\beta\right]\in\mathrm{PR}^{\Sigma}\)

Proof. (a) Primero notar que \(\lambda x\left[x\dot{-}1\right]=R\left(C_{0}^{0,0},p_{2}^{2,0}\right)\in\mathrm{PR}^{\Sigma}.\) También note que \[\lambda tx\left[x\dot{-}t\right]=R\left(p_{1}^{1,0},\lambda x\left[x\dot{-}1\right]\circ p_{1}^{3,0}\right)\in\mathrm{PR}^{\Sigma}.\] O sea que \(\lambda xy\left[x\dot{-}y\right]=\lambda tx\left[x\dot{-}t\right]\circ\left[p_{2}^{2,0},p_{1}^{2,0}\right]\in\mathrm{PR}^{\Sigma}\).

(b) Note que \(\lambda xy\left[\max(x,y)\right]=\lambda xy\left[x+(y\dot{-}x)\right]\).

(c) Note que \(\lambda xy\left[x=y\right]=\lambda xy\left[1\dot{-}((x\dot{-}y)+(y\dot{-}x))\right]\).

(d) Note que \(\lambda xy\left[x\leq y\right]=\lambda xy\left[1\dot{-}(x\dot{-}y)\right]\).

(e) Sea \(\leq\) un orden total sobre \(\Sigma.\) Ya que \[\alpha=\beta\text{ sii }\#^{\leq}(\alpha)=\#^{\leq}(\beta)\] tenemos que \[\lambda\alpha\beta\left[\alpha=\beta\right]=\lambda xy\left[x=y\right]\circ\left[\#^{\leq}\circ p_{1}^{0,2},\#^{\leq}\circ p_{2}^{0,2}\right]\] lo cual nos dice que \(\lambda\alpha\beta\left[\alpha=\beta\right]\) es \(\Sigma\)-p.r.

Dados predicados \(P:S\subseteq\omega^{n}\times\Sigma^{\ast m}\rightarrow\omega\) y \(Q:S\subseteq\omega^{n}\times\Sigma^{\ast m}\rightarrow\omega\), predicados con el mismo dominio, definamos nuevos predicados \((P\vee Q)\), \((P\wedge Q)\) y \(\lnot P\) de la siguiente manera \[\begin{aligned} & \begin{array}{rll} (P\vee Q):S & \rightarrow & \omega\\ (\vec{x},\vec{\alpha}) & \rightarrow & \left\{ \begin{array}{lll} 1 & & \text{si }P(\vec{x},\vec{\alpha})=1\text{ o }Q(\vec{x},\vec{\alpha})=1\\ 0 & & \text{caso contrario} \end{array}\right. \end{array}\\ & \begin{array}{rll} (P\wedge Q):S & \rightarrow & \omega\\ (\vec{x},\vec{\alpha}) & \rightarrow & \left\{ \begin{array}{lll} 1 & & \text{si }P(\vec{x},\vec{\alpha})=1\text{ y }Q(\vec{x},\vec{\alpha})=1\\ 0 & & \text{caso contrario} \end{array}\right. \end{array}\\ & \begin{array}{rll} \lnot P:S & \rightarrow & \omega\\ (\vec{x},\vec{\alpha}) & \rightarrow & \left\{ \begin{array}{lll} 1 & & \text{si }P(\vec{x},\vec{\alpha})=0\\ 0 & & \text{si }P(\vec{x},\vec{\alpha})=1 \end{array}\right. \end{array} \end{aligned}\]

4.14. Si \(P:D_{P}\subseteq\omega^{n}\times\Sigma^{\ast m}\rightarrow\omega\) y \(Q:D_{Q}\subseteq\omega^{n}\times\Sigma^{\ast m}\rightarrow\omega\) son predicados \(\Sigma\)-p.r. tales que \(D_{P}=D_{Q}\), entonces \((P\vee Q)\), \((P\wedge Q)\) y \(\lnot P\) son \(\Sigma\)-p.r..

Proof. Note que \[\begin{aligned} \lnot P & =\lambda xy\left[x\dot{-}y\right]\circ\left[C_{1}^{n,m},P\right]\\ (P\wedge Q) & =\lambda xy\left[x.y\right]\circ[P,Q]\\ (P\vee Q) & =\lnot(\lnot P\wedge\lnot Q). \end{aligned}\]

Un conjunto \(\Sigma\)-mixto \(S\subseteq\omega^{n}\times\Sigma^{\ast m}\) es llamado \(\Sigma\)-recursivo primitivo si su función característica \(\chi_{S}^{\omega^{n}\times\Sigma^{\ast m}}\) es \(\Sigma\)-p.r.. (Nótese que \(\chi_{S}^{\omega^{n}\times\Sigma^{\ast m}}\) es el predicado \(\lambda\vec{x}\vec{\alpha}\left[(\vec{x},\vec{\alpha})\in S\right]\).)

4.15. Si \(S_{1},S_{2}\subseteq\omega^{n}\times\Sigma^{\ast m}\) son \(\Sigma\)-p.r., entonces \(S_{1}\cup S_{2}\), \(S_{1}\cap S_{2}\) y \(S_{1}-S_{2}\) lo son.

Proof. Note que \[\begin{aligned} \chi_{S_{1}\cup S_{2}}^{\omega^{n}\times\Sigma^{\ast m}} & =(\chi_{S_{1}}^{\omega^{n}\times\Sigma^{\ast m}}\vee\chi_{S_{2}}^{\omega^{n}\times\Sigma^{\ast m}})\\ \chi_{S_{1}\cap S_{2}}^{\omega^{n}\times\Sigma^{\ast m}} & =(\chi_{S_{1}}^{\omega^{n}\times\Sigma^{\ast m}}\wedge\chi_{S_{2}}^{\omega^{n}\times\Sigma^{\ast m}})\\ \chi_{S_{1}-S_{2}}^{\omega^{n}\times\Sigma^{\ast m}} & =\lambda xy\left[x\dot{-}y\right]\circ\left[\chi_{S_{1}}^{\omega^{n}\times\Sigma^{\ast m}},\chi_{S_{2}}^{\omega^{n}\times\Sigma^{\ast m}}\right] \end{aligned}\]

4.1. Si \(S\subseteq\omega^{n}\times\Sigma^{\ast m}\) es finito, entonces \(S\) es \(\Sigma\)-p.r..

Proof. Si \(S=\emptyset\), entonces es claro que \(S\) es \(\Sigma\)-p.r.. Probaremos ahora el lema para el caso en que \(S\) tiene un solo elemento. Supongamos entonces \[S=\{(z_{1},...,z_{n},\gamma_{1},...,\gamma_{m})\}.\] Note que \(\chi_{S}^{\omega^{n}\times\Sigma^{\ast m}}\) es el siguiente predicado \[\left(\chi_{\{z_{1}\}}^{\omega}\circ p_{1}^{n,m}\wedge...\wedge\chi_{\{z_{n}\}}^{\omega}\circ p_{n}^{n,m}\wedge\chi_{\{\gamma_{1}\}}^{\Sigma^{\ast}}\circ p_{n+1}^{n,m}\wedge...\wedge\chi_{\{\gamma_{m}\}}^{\Sigma^{\ast}}\circ p_{n+m}^{n,m}\right).\] Ya que los predicados \[\begin{aligned} \chi_{\{z_{i}\}}^{\omega} & =\lambda xy\left[x=y\right]\circ\left[p_{1}^{1,0},C_{z_{i}}^{1,0}\right]\\ \chi_{\{\gamma_{i}\}}^{\Sigma^{\ast}} & =\lambda\alpha\beta\left[\alpha=\beta\right]\circ\left[p_{1}^{0,1},C_{\gamma_{i}}^{0,1}\right] \end{aligned}\] son \(\Sigma\)-p.r., el Lema 4.14 (aplicado \((n+m)-1\) veces), implica que \(\chi_{S}^{\omega^{n}\times\Sigma^{\ast m}}\) es \(\Sigma\)-p.r.. Cuando \(S\) tiene mas de un elemento, ya que entonces es la unión de una cantidad finita de conjuntos de un solo elemento, se puede aplicar el Lema 4.15 (\(\left\vert S\right\vert -1\) veces) para obtener que \(S\) es \(\Sigma\)-p.r..

El siguiente lema caracteriza cuando un conjunto rectangular es \(\Sigma\)-p.r..

4.16. Supongamos \(S_{1},...,S_{n}\subseteq\omega\), \(L_{1},...,L_{m}\subseteq\Sigma^{\ast}\) son conjuntos no vacíos, con \(n,m\in\omega\). Entonces \(S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}\) es \(\Sigma\)-p.r. sii \(S_{1},...,S_{n},L_{1},...,L_{m}\) son \(\Sigma\)-p.r.

Proof. (\(\Rightarrow\)) Veremos por ejemplo que \(L_{1}\) es \(\Sigma\)-p.r.. Sea \((z_{1},...,z_{n},\zeta_{1},...,\zeta_{m})\) un elemento fijo de \(S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}.\) Note que \[\alpha\in L_{1}\text{ sii }(z_{1},...,z_{n},\alpha,\zeta_{2},...,\zeta_{m})\in S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m},\] lo cual implica que \[\chi_{L_{1}}^{\Sigma^{\ast}}=\chi_{S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}}^{\omega^{n}\times\Sigma^{\ast m}}\circ\left[C_{z_{1}}^{0,1},...,C_{z_{n}}^{0,1},p_{1}^{0,1},C_{\zeta_{2}}^{0,1},...,C_{\zeta_{m}}^{0,1}\right]\] (\(\Leftarrow\)) Note que \(\chi_{S_{1}\times...\times S_{n}\times L_{1}\times...\times L_{m}}^{\omega^{n}\times\Sigma^{\ast m}}\) es el predicado \[\left(\chi_{S_{1}}^{\omega}\circ p_{1}^{n,m}\wedge...\wedge\chi_{S_{n}}^{\omega}\circ p_{n}^{n,m}\wedge\chi_{L_{1}}^{\Sigma^{\ast}}\circ p_{n+1}^{n,m}\wedge...\wedge\chi_{L_{m}}^{\Sigma^{\ast}}\circ p_{n+m}^{n,m}\right).\]

Dada una función \(f\) y un conjunto \(S\subseteq D_{f}\), usaremos \(f|_{S}\) para denotar la restricción de \(f\) al conjunto \(S\), i.e. \(f|_{S}=f\cap(S\times I_{f})\). Nótese que \(f|_{S}\) es la función dada por \[D_{f|_{S}}=S\ \ \ \text{y}\ \ \ f|_{S}(e)=f(e)\text{, para cada }e\in S\]

4.17. Sean \(n,m\in\omega\) y \(O\in\{\omega,\Sigma^{\ast}\}\). Supongamos \(f:D_{f}\subseteq\omega^{n}\times\Sigma^{\ast m}\rightarrow O\) es \(\Sigma\)-p.r.. Si \(S\subseteq D_{f}\) es \(\Sigma\)-p.r., entonces \(f|_{S}\) es \(\Sigma\)-p.r..

Proof. Supongamos \(O=\Sigma^{\ast}\). Entonces \[f|_{S}=\lambda x\alpha\left[\alpha^{x}\right]\circ\left[Suc\circ Pred\circ\chi_{S}^{\omega^{n}\times\Sigma^{\ast m}},f\right]\] lo cual nos dice que \(f|_{S}\) es \(\Sigma\)-p.r.. El caso \(O=\omega\) es similar usando \(\lambda xy\left[x^{y}\right]\) en lugar de \(\lambda x\alpha\left[\alpha^{x}\right]\).